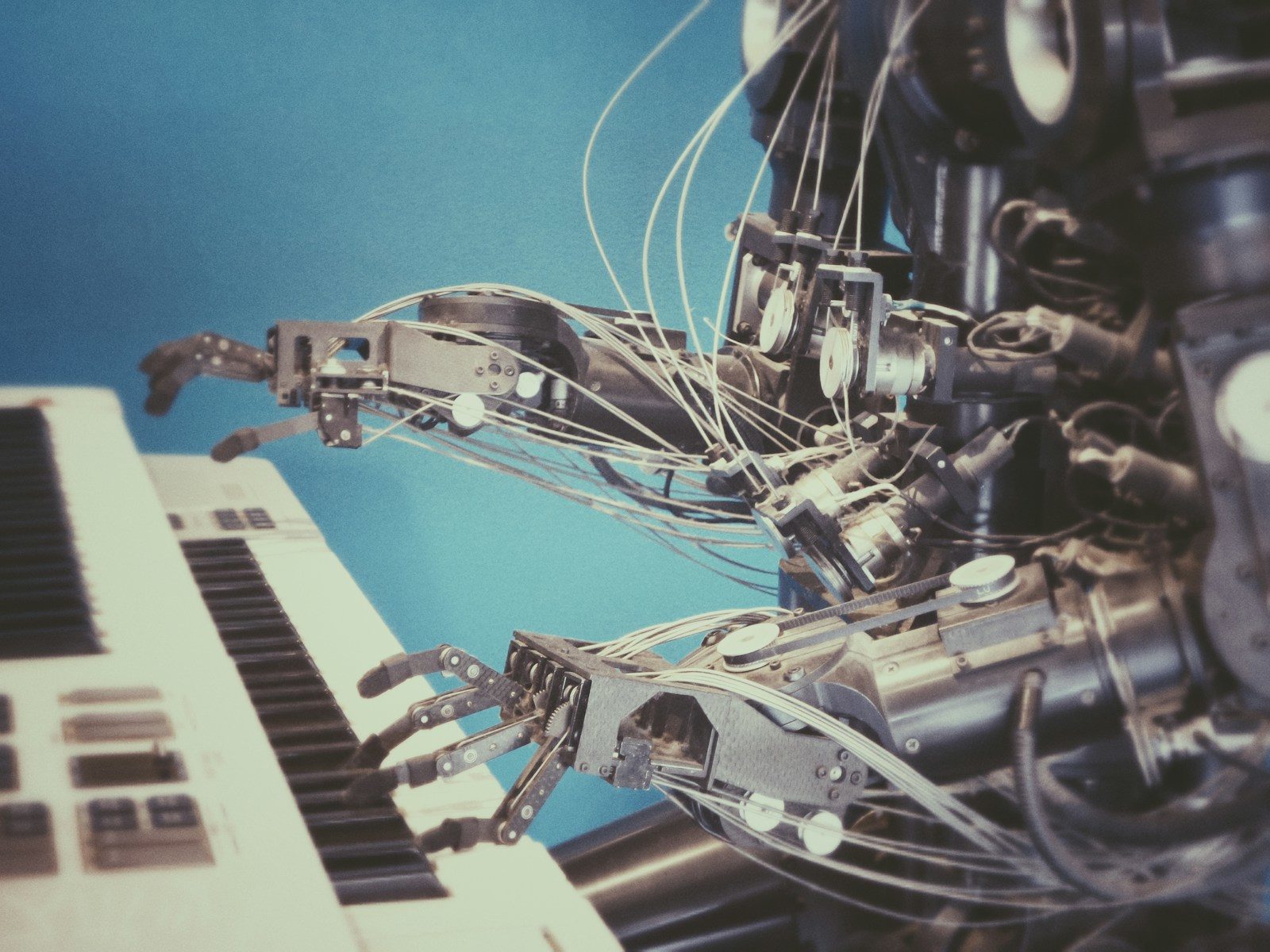

Por qué la IA local es mucho más fácil en 2026

La IA local ya no es un proyecto de nicho para entusiastas con equipos refrigerados por líquido. En 2026, la tendencia hacia la ejecución de modelos en tu propio hardware ha llegado a un punto de inflexión. Los usuarios están cansados de las cuotas mensuales y de la molesta sensación de que sus datos se utilizan para entrenar el próximo gran modelo corporativo. El hardware de los portátiles estándar finalmente ha alcanzado las exigencias de los modelos de lenguaje de gran tamaño. Esta transición no es solo una cuestión de velocidad. Se trata de un cambio fundamental en cómo interactuamos con el software. Nos estamos alejando de un mundo donde cada consulta viaja a una granja de servidores en Virginia y regresa. Este año marca el momento en que el profesional promedio puede ejecutar un asistente de alta calidad sin conexión a internet. Los beneficios son claros: obtienes menor latencia, mejor privacidad y cero costes recurrentes. Sin embargo, el camino hacia la autonomía local no está exento de obstáculos. Los requisitos de hardware siguen siendo altos para los modelos más capaces. La brecha entre lo que puede ofrecer un gigante de la nube y lo que puede hacer tu portátil se está reduciendo, pero aún existe.

El cambio hacia la inteligencia en el dispositivo

Para entender por qué la IA local está ganando, debemos mirar el silicio. Durante años, la unidad central de procesamiento y la tarjeta gráfica hicieron todo el trabajo pesado. Ahora, cada fabricante importante de chips incluye una unidad de procesamiento neuronal o NPU dedicada. Este hardware especializado está diseñado para manejar las matemáticas específicas requeridas para las redes neuronales sin agotar tu batería en veinte minutos. Empresas como NVIDIA han superado los límites de lo que pueden manejar los chips de consumo. Al mismo tiempo, el lado del software ha experimentado un movimiento masivo hacia la eficiencia. Los modelos de lenguaje pequeños o SLM son las estrellas de 2026. Estos modelos están entrenados para ser altamente eficientes, a menudo superando a modelos mucho más grandes en tareas específicas como la programación o el resumen de documentos. Los desarrolladores están utilizando técnicas como la cuantización para reducir estos modelos y que quepan en la memoria RAM de un dispositivo de consumo estándar. En lugar de un modelo que requiera ochenta gigabytes de memoria, ahora tenemos asistentes capaces que funcionan con ocho o dieciséis gigabytes. Esto significa que tu teléfono o tu portátil fino ahora pueden manejar tareas que antes requerían un rack de servidores. El ecosistema de software también ha madurado. Las herramientas que antes requerían conocimientos complejos de línea de comandos ahora vienen con instaladores de un solo clic. Puedes descargar un modelo, apuntarlo a tus archivos locales y empezar a hacer preguntas en minutos. Esta accesibilidad es lo que cambió recientemente. La barrera de entrada ha pasado de ser un muro alto a un pequeño escalón. La mayoría de los usuarios ni siquiera se dan cuenta de que están ejecutando modelos locales porque la interfaz se ve igual que las herramientas en la nube por las que solían pagar.

Soberanía y el cambio global de datos

El paso a la IA local no es solo una tendencia para los fanáticos de la tecnología en Silicon Valley. Es una necesidad global impulsada por las variadas leyes de datos y la necesidad de soberanía digital. En regiones como la Unión Europea, las estrictas regulaciones de privacidad hacen que la IA basada en la nube sea un dolor de cabeza legal para muchas corporaciones. Al mantener los datos en servidores locales o dispositivos individuales, las empresas pueden evitar los riesgos asociados con las transferencias de datos a través de fronteras. Esto es particularmente vital para los sectores de la salud y legal. Un abogado en Berlín o un médico en Tokio no pueden arriesgarse a que información confidencial del cliente se filtre en un conjunto de entrenamiento público. La IA local proporciona un muro sólido entre los datos privados y la web pública. Además, este cambio ayuda a cerrar la brecha en áreas con infraestructura de internet poco fiable. En muchas partes del mundo, la fibra de alta velocidad no es algo garantizado. Los modelos locales permiten a investigadores y estudiantes utilizar herramientas avanzadas sin necesidad de una conexión constante de gran ancho de banda. Esto democratiza el acceso a la información de una manera que las herramientas solo en la nube nunca podrían. Estamos viendo un aumento en la IA soberana, donde las naciones invierten en sus propios modelos localizados para asegurar que no dependan de gigantes tecnológicos extranjeros. Este movimiento garantiza que los matices culturales y los idiomas locales estén mejor representados. Cuando el modelo vive en tu hardware, tú controlas el sesgo y el resultado. Ya no estás a merced de los filtros de contenido o las interrupciones de servicio de una corporación distante. Considera estos impulsores principales para la adopción global:

- Cumplimiento con las leyes regionales de residencia de datos como el RGPD.

- Reducción de la latencia para usuarios en regiones remotas o en desarrollo.

- Protección de la propiedad intelectual en industrias altamente competitivas.

- Reducción de los costes operativos a largo plazo para pequeñas empresas.

El nuevo flujo de trabajo diario

Imagina una jornada laboral típica para una creativa freelance llamada Sarah. En el pasado, Sarah pasaba su mañana subiendo archivos de vídeo grandes a un servicio en la nube para su transcripción y luego usando una herramienta de chat basada en la web para intercambiar ideas sobre guiones. Cada paso implicaba un retraso y una posible filtración de privacidad. Hoy, Sarah comienza su día abriendo una interfaz local. Arrastra una entrevista de dos horas a una herramienta local que transcribe el audio en segundos usando la NPU de su portátil. No hay espera en la cola de un servidor. A continuación, utiliza un modelo local para resumir la entrevista y encontrar citas clave. Debido a que el modelo tiene acceso directo a su sistema de archivos local, puede hacer referencias cruzadas de esta entrevista con sus notas de hace tres años. Hace todo esto mientras su Wi-Fi está apagado. Más tarde, necesita generar algunas imágenes para una presentación. En lugar de pagar una suscripción a un servicio que podría cambiar sus términos de servicio mañana, ejecuta un generador de imágenes local. Obtiene exactamente lo que necesita sin la preocupación de que sus prompts sean registrados.

BotNews.today utiliza herramientas de IA para investigar, escribir, editar y traducir contenido. Nuestro equipo revisa y supervisa el proceso para mantener la información útil, clara y fiable.

¿Tienes una historia, herramienta, tendencia o pregunta sobre IA que crees que deberíamos cubrir? Envíanos tu idea de artículo — nos encantaría escucharla.

Preguntas difíciles para el futuro local

Aunque los beneficios son claros, debemos preguntarnos qué estamos sacrificando por esta independencia. La primera gran preocupación es el coste medioambiental del hardware. Si cada individuo está ejecutando sus propios modelos de IA que consumen mucha energía, ¿qué le hace eso a nuestro consumo total de energía? Los proveedores de la nube pueden optimizar sus centros de datos para la eficiencia, pero tu oficina en casa probablemente no esté optimizada para la gestión térmica. También debemos mirar el desperdicio de hardware. Para ejecutar los últimos modelos, se anima a los usuarios a actualizar sus dispositivos cada dos años. Esto crea una montaña de residuos electrónicos que compensa algunos de los beneficios percibidos de la tecnología. Otra pregunta crítica involucra la ilusión de privacidad. Si tu IA es local pero tu sistema operativo sigue enviando telemetría a una empresa matriz, ¿están tus datos realmente seguros? Muchas herramientas de IA local todavía requieren una conexión inicial para descargar pesos o verificar licencias. Debemos preguntar quién posee los pesos de estos modelos. Si un modelo es de código abierto, ¿quién es responsable cuando proporciona información peligrosa o incorrecta? También existe el problema de la brecha de inteligencia. Aunque los modelos locales están mejorando, los modelos masivos ejecutados por empresas de billones de dólares siempre serán más capaces. ¿Estamos creando una sociedad de dos niveles donde aquellos que pueden pagar la nube tienen mejor información que aquellos que dependen del hardware local? Debemos ser escépticos ante la idea de que la IA local es una solución perfecta. Es un intercambio. Cambias potencia bruta por privacidad y control de costes. Para muchos, ese es un trato justo, pero no deberíamos ignorar los costes ocultos de la carrera del hardware. También deberíamos observar las implicaciones de privacidad de la IA local en comparación con las configuraciones tradicionales en la nube para ver si las ganancias de seguridad son reales o percibidas.

Análisis profundo para usuarios avanzados

Para los usuarios avanzados, la escena de la IA local se centra en la optimización y la integración. Las configuraciones más populares actualmente giran en torno a Llama.cpp y backends similares que permiten una inferencia de alta velocidad en hardware de consumo. La cuantización es el término clave aquí. La mayoría de los usuarios están ejecutando versiones de 4 o 6 bits de modelos populares, que proporcionan un equilibrio casi perfecto entre el tamaño del archivo y la inteligencia. Si tienes una máquina con 64 GB de memoria unificada, puedes ejecutar cómodamente modelos de 30B o incluso 70B de parámetros a velocidades utilizables. La integración de RAG local o Generación Aumentada por Recuperación también se ha convertido en estándar. Esto permite que tu modelo local consulte una base de datos vectorial de tus propios documentos, dándole efectivamente a la IA una memoria a largo plazo de toda tu vida digital. Los límites de API son cosa del pasado para el usuario local. Puedes ejecutar millones de tokens al día sin ver una sola factura. Sin embargo, el cuello de botella sigue siendo la VRAM. Aunque las NPU están ayudando, una GPU dedicada con gran ancho de banda de memoria sigue siendo la reina de la IA local. Muchos usuarios ahora están construyendo PC de IA diseñados específicamente con RAM de alta velocidad y almacenamiento NVMe local masivo para albergar cientos de modelos diferentes. El flujo de trabajo generalmente implica una puerta de enlace local que imita la estructura de la API de OpenAI, lo que te permite intercambiar un modelo local en cualquier herramienta existente que admita IA en la nube. Esta compatibilidad directa es lo que ha hecho que las configuraciones locales sean tan potentes para los desarrolladores. Puedes probar tu código localmente de forma gratuita y solo desplegarlo en la nube cuando sea necesario. Plataformas como Hugging Face se han convertido en la biblioteca central para estos modelos, proporcionando las materias primas para este movimiento local. Las consideraciones técnicas clave para 2026 incluyen:

- Límites de la ventana de contexto basados en la memoria del sistema disponible.

- Estrangulamiento térmico durante sesiones largas de inferencia en dispositivos móviles.

- El surgimiento de flujos de trabajo híbridos que utilizan modelos locales para redactar y modelos en la nube para la verificación final.

- El uso de contenedores Docker para gestionar entornos de IA locales sin saturar el sistema operativo anfitrión.

En resumen

La IA local en 2026 trata sobre recuperar el volante. Hemos dejado atrás la era en la que cada función inteligente requería una conexión a una nave nodriza corporativa. La combinación de chips especializados, modelos eficientes y software fácil de usar ha hecho que la inteligencia en el dispositivo sea el estándar para los profesionales. Aunque la nube siempre tendrá su lugar para proyectos de escala masiva y colaborativos, la IA personal es ahora verdaderamente personal. Es más rápida, más barata y más privada que nunca. La transición no está completa y los límites del hardware todavía existen, pero la dirección es clara. El futuro de la IA no está solo en la nube. Está en tu escritorio, en tu bolsillo y bajo tu control. Ya no eres solo un suscriptor. Eres el administrador de tu propia inteligencia.

Nota del editor: Creamos este sitio como un centro multilingüe de noticias y guías sobre IA para personas que no son expertos en informática, pero que aún quieren entender la inteligencia artificial, usarla con más confianza y seguir el futuro que ya está llegando.

¿Encontraste un error o algo que deba corregirse? Háznoslo saber.