2026年、欧州AIの逆襲が始まる!「主権型スタック」が変えるテックの未来

欧州独自の「主権型スタック」が台頭

2026年、欧州は並々ならぬ決意で新しい年を迎えました。長年、アメリカや中国が未来を創る一方で、欧州は「古いテックの博物館」なんて言われてきましたが、そんな時代はもう終わり。データ主権が単なる政策の注釈ではなく、国家安全保障の最優先事項になったからです。2026 までに、焦点は単なる規制から、アメリカ西海岸のサーバーに依存しない「スタック」の構築へとシフトしました。これはシリコンバレーと同じ土俵で戦うということではありません。プライバシーや産業界の精度を、消費者のバイラルループよりも重視する「パラレルシステム」を作ることなんです。その成果はパリ、ミュンヘン、ストックホルムで目に見える形になっています。政府も企業も、もはや中身のわからない「ブラックボックス」なモデルには満足していません。データがどこにあり、誰が鍵を握っているのかを知りたがっているのです。この変化が、生のスケールよりもコントロールを優先する、ローカライズされたインテリジェンスというユニークな市場を生み出しています。

主権型スタックを構築する

欧州戦略の核となるのは「ソブリン・クラウド(主権型クラウド)」です。これは、データが国境内に留まり、現地の法律の下で管理されることを意味します。アメリカのCloud Actや、不安定なグローバルデータ合意への直接的な回答ですね。MistralやAleph Alphaといった企業は、単にモデルを作っているだけではありません。彼らが作っているのは、透明性のある「重み(weights)」を持ち、ローカルなハードウェアで動作するモデルです。確かに計算リソースの不足は深刻です。アイオワやネバダにあるような巨大なGPUクラスターは欧州にはありません。しかし、彼らは「効率」で勝負しています。巨大なモデルよりも、よりスマートで効率的なモデルが優先されているのです。これは「大きいほど良い」から「賢いほど良い」へのシフト。目標は、精度を犠牲にすることなく、控えめなインフラでハイパフォーマンスなAIを動かすことです。このアプローチは、高い稼働率とデータ漏洩ゼロを求めるドイツやフランスの巨大な産業基盤に刺さっています。

欧州の**主権型AIインフラ**へのアプローチには、3つのレイヤーがあります。1つ目はハードウェア。European Processor Initiativeのような取り組みで、外部のシリコンへの依存を減らそうとしています。2つ目はホスティング。OVHcloudやHetznerといった地元のプレイヤーが主導しています。そして3つ目がモデル。この地域のオープンソースへの貢献が、透明性の新しい基準を作っています。これらのレイヤーが連携することで、大西洋を越えてデータを1パケットも送ることなくAIをデプロイできる環境が整いつつあります。これは単なるプライドの問題ではなく、データが最も価値のある資産となった世界で、法的コンプライアンスを守り、企業秘密を保護するための戦略なのです。欧州のテックセクターは、世界が最終的にこのレベルのコントロールを渇望するようになると賭けています。

- 厳格なGDPRやAI Actの要件を満たすローカルなデータレジデンシー。

- 深い監査やカスタマイズを可能にするオープンソースのモデルウェイト。

- 欧州の高コストな電力環境に合わせて設計されたエネルギー効率の高いアーキテクチャ。

「ブリュッセル標準」を世界へ

この変化が世界に与える影響、それが「ブリュッセル効果」です。欧州が規制を作れば、世界がそれに従う。2026 年、AI Actはアルゴリズムのリスクをどう扱うべきかの世界的なベンチマークになりました。アジアや北米の企業も、欧州の単一市場にアクセスするために欧州基準を採用し始めています。これにより、安全性と倫理の底上げがなされました。一方で、資本の断片化も起きています。投資家は、欧州のスタートアップに伴う重いコンプライアンスコストを警戒することもあります。それでも、多くの企業にとって法的確実性は、そのコストを払う価値があるものです。ここで世間の認識と現実にズレが生じます。多くの人は規制がイノベーションを殺すと過大評価していますが、実際には、企業がAIを導入するための明確なロードマップを提供しているのです。大手銀行や医療機関は、ルールが明確で法的拘束力がある方が、安心してAIを使えますからね。

BotNews.today は、AIツールを使用してコンテンツの調査、執筆、編集、翻訳を行っています。 当社のチームは、情報が有用で明確、信頼できるものであるよう、プロセスをレビューし監督しています。

現場の産業リアリティ

ロッテルダム港のロジスティクスマネージャー、エレナの例を見てみましょう。彼女の仕事は、毎日数千個のコンテナの流れを管理すること。以前なら、遅延予測にアメリカ製の汎用ツールを使っていたかもしれませんが、今は欧州モデルをベースにしたローカライズAIを使っています。彼女の朝は7:00に始まります。近くのデータセンターにあるプライベートクラウドで動く端末にログイン。その施設は約5000 m2 の広さで、廃熱は地元の住宅の暖房に使われています。AIは交通パターン、天候、労働状況を分析。このモデルは欧州の港特有のデータで学習されているため、汎用モデルが見落としがちな現地の労働法や環境規制のニュアンスまで理解しています。単に「早いルート」を提案するのではなく、「法的にもクリーンで、カーボン効率の良いルート」を教えてくれるのです。

10:00、エレナは組合の代表と面談します。AIの推奨事項について話し合う際、モデルが透明なので、なぜシステムがその選択をしたのかを正確に示すことができます。ブラックボックスはありません。この透明性が、労働の平穏を保つために不可欠なのです。午後は自動クレーン群との調整。処理が数千キロ離れたサーバーファームではなく、エッジで行われるため、レイテンシ(遅延)はほぼゼロ。これこそが、多くの人が過小評価している「産業用AI」の現実です。みんな欧州版のチャットボットを探しがちですが、真の力は、大陸のインフラを動かしているこうした目に見えないシステムにあります。一日の終わりには、エレナは10%少ないエネルギーで、貨物量を15%増やしました。データが港の管轄外に出ることは一度もありません。これが主権型スタックがもたらす約束の実践です。実用的で、ローカライズされ、そして安全なのです。

デジタル自律の高すぎる代償?

では、この独立の隠れたコストは何でしょうか?ここではソクラテス的な懐疑心が必要です。主権の追求は、単にスケール不足を隠すための口実ではないでしょうか?データを国境内に縛り付けることで、欧州はグローバルな巨人と競うために必要な、大規模で多様なデータセットをモデルに与えられなくなっているかもしれません。また、「主権税」も存在します。ローカルホスティングやコンプライアンスは高価です。小さなスタートアップは、AI Actに対応するための法務チームを雇う余裕がないかもしれません。最大手企業しか手を出せないシステムを作っているのではないでしょうか?もう一つの疑問は、計算リソースの差を埋められるのかという点です。ハードウェアのパワーで常に二歩遅れているなら、モデルの能力もいずれ遅れをとるのでは?倫理へのこだわりが、本物の道徳的立場なのか、それともAIブームの第一波に乗り遅れたことへの便利な言い訳なのか、私たちは問い続けなければなりません。

AIに関するストーリー、ツール、トレンド、または取り上げるべき質問がありますか? 記事のアイデアをお送りください — ぜひお聞かせください。

欧州中心モデルの裏側

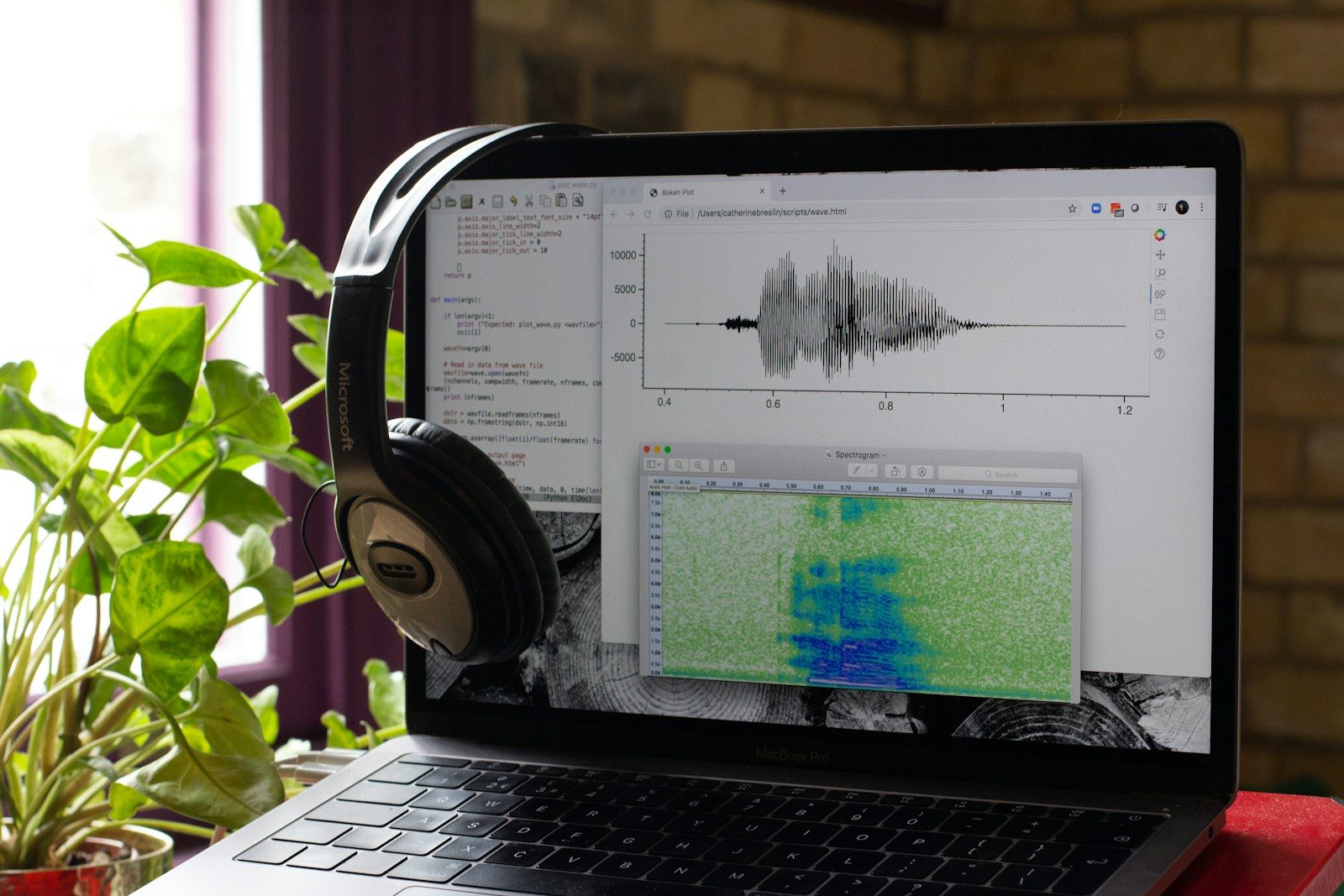

欧州AIの技術的現実は「制約」によって定義されています。開発者は無限の計算リソースに頼れないため、モデルの蒸留(distillation)や量子化(quantization)に注力しています。これにより、巨大なモデルをより小さく手頃なハードウェアで動かせるようになります。例えば、Mistral 7Bは、学習データの質が高ければ、小さなモデルでも遥かに大きなモデルを凌駕できることを証明しました。2026年のトレンドは、ローカルなベクトルデータベースを使ったRAG(検索拡張生成)です。これにより、コアモデルは汎用的なまま、特定の機密データは安全なローカルのサイロに保管されます。主権型クラウドのAPI制限は、アメリカの大手プロバイダーよりも厳しいことが多いですが、それが逆に開発者に、よりクリーンで効率的なコードを書くことを強いています。ローカルストレージはS3互換のオブジェクトストレージなどで処理されますが、欧州製の鍵を使った保存時および転送時の暗号化が徹底されています。

- SAPのような地元のERPシステムと統合し、シームレスなデータフローを実現。

- 共有の主権インフラの安定性を維持するための厳格なAPIレート制限。

- Data Actに準拠するためのローカルストレージノードの使用義務化。

レイテンシも重要な要素です。ローカルノードを使うことで、欧州企業は重要な産業アプリケーションにおいて20ms以下のレスポンスタイムを実現できます。複数の大陸を経由するグローバルなAPIエンドポイントでは、これを保証するのは困難です。欧州AIシーンのギークな部分は、派手なデモよりも「配管(プランミング)」にあります。彼らは、断片化され厳格に規制された環境でAIを機能させるためのコネクタ、安全なトンネル、そして専門化されたデータセットを構築しています。エンタープライズ顧客にとって価値の80%を生み出すスタックの20%、つまり法律、医療、エンジニアリングに特化した、高品質な欧州のデータで訓練されたモデルに集中しているのです。

2026年の最終評決

欧州は、古いルールでAIレースに勝とうとはしていません。レースのルールそのものを変えようとしているのです。2026 までに、この地域は安全で産業的なAIのリーダーとしての地位を確立しました。アメリカがコンシューマー市場を支配し、中国が監視技術をリードする一方で、欧州はリスクが高く規制の厳しい産業で独自のニッチを見つけました。規制と実行の間の緊張は依然として残っています。一部のスタートアップは、より簡単な資金調達を求めて今もアメリカへ逃げ出すでしょう。しかし、残った者たちは、何か耐久性のあるものを築き上げています。問いはまだ消えていません。欧州は、テクノロジーの僻地になることなく倫理基準を維持できるでしょうか?これからの数年が、主権が盾になるのか、それとも檻になるのかを決定づけるでしょう。今のところ、賭けは「コントロールがパワーと同じくらい重要になる未来」に向けられています。

編集者注: 当サイトは、コンピューターオタクではないものの、人工知能を理解し、より自信を持って使いこなし、すでに到来している未来を追いかけたいと願う人々のための、多言語対応のAIニュースおよびガイドハブとして作成されました。

エラーを見つけたり、修正が必要な点がありましたか? お知らせください。