AIの物理的コスト:計算能力、電力、そしてグローバルサプライチェーン

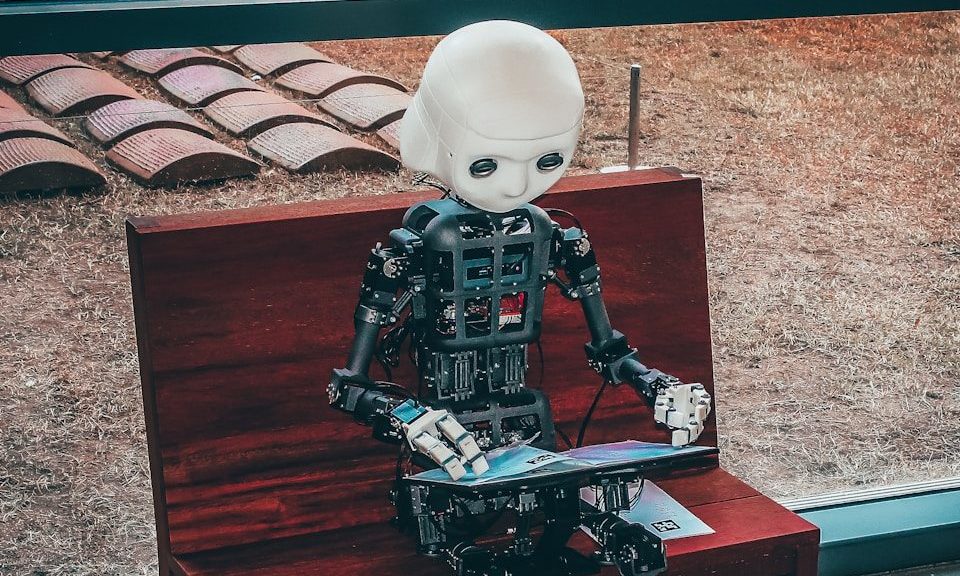

チャットボットに詩を書かせたり、長い会議の要約を頼んだりしたとき、裏で何が起きているか不思議に思ったことはありませんか?まるで魔法みたいですよね。数単語入力するだけで、画面には賢い回答がパッと現れる。多くの人は、これがどこにも存在せず、同時にどこにでも存在する「見えないクラウド」の中で起きていると思っています。でも真実は、もっと地に足のついた、正直に言ってかなりワクワクするような話なんです。私たちがこれらのスマートツールを使うたびに、実は巨大な物理的マシン、何マイルにも及ぶケーブル、そして膨大な電力のネットワークにアクセスしているのです。蛇口をひねったときに、その水を流すために裏でパイプや貯水池のシステムが動いていることを思い出すようなものですね。今、私たちはこれらの便利なツールの成長が、金属やシリコン、発電所といった極めて現実的なものに依存していることを目の当たりにしています。これを理解することは、世界がどのように変化しているかという全体像を把握する助けになります。単なるコードの話ではありません。アイデアを現実のものにするための、素晴らしい物理的な努力の物語なのです。

AIは空中に浮かぶ数学の塊だというよくある誤解があります。数学も大切ですが、物理的な場所がなければ何もできません。その「家」となるのは、日々進化を続けるハードウェアです。物理的な側面から見ることで、なぜ一部のアプリが他のアプリより高速なのか、なぜテック企業が人里離れた場所に巨大なビルを建てているのかがよくわかります。これは人間の創意工夫と、力を合わせたときに作り出せる驚くべき成果の物語です。私たちは「テクノロジーは画面の中だけのもの」という考えから脱却し、それが物理的な世界の一部であることに気づき始めています。

エラーを見つけたり、修正が必要な点がありましたか? お知らせください。エンジンの裏側

これがどう機能しているか理解するために、巨大なプロの厨房を想像してみてください。街全体に食事を提供しようと思ったら、素敵なレシピだけでは足りません。高性能なオーブン、巨大な冷蔵庫、そして新鮮な食材の絶え間ない供給が必要です。テックの世界では、そのオーブンにあたるのが「GPU」と呼ばれる特殊なチップです。これは普通のPCパーツとは違います。何千もの計算を同時にこなすよう設計された、ハイパフォーマンスなエンジンなのです。あなたがAIにリクエストを送ると、それは光ファイバーケーブルを通ってデータセンターへ飛びます。そこは、こうした強力なチップがずらりと並ぶ巨大な建物です。NVIDIAのような企業は、毎年これらのチップをより速く、より効率的にするために懸命に取り組んでいます。

こうしたデータセンターは、サッカー場数個分もの広さになることもあります。広いスペースと、それ以上の冷却能力が必要です。チップはフル稼働するため、長旅の車のエンジンのように非常に熱くなります。企業は巨大なファンや液冷システムなどを使い、すべてをスムーズに動かすための高度な冷却設備を構築しなければなりません。これがクラウドの物理的な現実です。24時間365日稼働する、非常に重くてリアルなハードウェアの集まりなのです。これらの物理的な拠点なしでは、世界で最も賢いソフトウェアも住む場所がありません。これこそが、今日あなたのスマホにあるすべてのスマートアプリを支えるバックボーンなのです。

最近、これらの建物の設計方法に変化が見られます。単なるコンピュータの倉庫ではなく、自らのエネルギー使用量を管理できるスマートなハブへと進化しています。この変化は重要です。データセンターごとに新しい発電所を建てることなく、より多くのAIパワーを得られるようになるからです。限られたリソースを賢く使うことがすべてです。「クラウド」という言葉を聞いたら、史上最も高度なテクノロジーが詰まった、唸りを上げる巨大な部屋を想像してみてください。私たちのデジタルライフを可能にしているのは、この物理的な驚異なのです。あなたの質問を瞬時に回答に変えてくれるのは、このハードウェアのおかげです。

世界規模のチームプレー

テクノロジーの物理的な側面は、世界中の人々をつなぐ真にグローバルな物語です。まずは強力なチップを作るために必要な材料から始まります。希少な鉱物が様々な国で採掘され、高度に専門化された工場へと送られます。最先端のチップのほとんどは、台湾の熟練した製造パートナーによって作られています。そこからこれらの部品は海を渡り、アメリカ、ヨーロッパ、アジアのデータセンターへと届けられます。つまり、ブラジルでスマート検索ツールを使っている人は、何十もの国々の部品で作られたハードウェアに支えられているということです。これは、私たちが協力して有益なものを作り出している素晴らしい例です。このグローバルなつながりは、各国が協力しリソースを共有することを促すため、非常に喜ばしいことです。

また、建設、エネルギー管理、ハードウェアメンテナンスの分野で雇用も生み出しています。2024年を通じ、こうしたセンターを支えるために地域の電力網への投資が増えているのがわかります。これは多くの場合、地域の誰にとっても有益なインフラの改善につながります。テック企業が新しいデータセンターを建てるとき、それを動かすための風力や太陽光発電といった新しいグリーンエネルギープロジェクトに資金提供することもよくあります。つまり、よりスマートな技術への追求は、地球全体のエネルギー供給方法を改善することにもつながっているのです。これはテック界にとっても、私たちのグローバルコミュニティにとっても勝利です。国際エネルギー機関 (IEA)は、こうした傾向を追跡し、各国がより明るく持続可能な未来を計画できるよう支援しています。botnews.todayで最新のAIニュースやアップデートをフォローすれば、こうしたグローバルネットワークがどのように成長し変化しているかを知ることができます。

チップへの需要は非常に高く、物流や輸送のあり方まで変えてしまいました。国境を越えて商品をより速く、より安全に運ぶ新しい方法が登場しています。この努力により、大都市のワーカーと同じくらい簡単に、小さな村の子供も最新のツールを使えるようになります。物理的な基盤を、私たちの集合的な想像力を支えられるほど強固なものにすることがすべてです。もはや1、2カ国にある少数のテックハブだけを見ているわけではありません。世界中がこの物理的なネットワークの一部になりつつあるのです。つまり、AIの進歩の恩恵がこれまで以上に多くの場所で感じられているということです。私たちの物理的な世界が、デジタルなニーズを満たすためにどう適応しているかを見るのは、とてもエキサイティングなことです。

あるワンクリックの旅

マーケティングにAIを活用している小規模ビジネスオーナー、サラの1日を見てみましょう。サラは朝起きると、タブレットにパン屋のニュースレターの草案作成を頼みます。その瞬間、彼女のリクエストは自宅を離れ、地元のインターネット回線を駆け抜けます。一連のルーターやスイッチを通り抜け、数百マイル離れた巨大なデータセンターへと到達します。そのセンター内では、チップのクラスターが動き出します。リクエストを処理するために大量の電力を消費し、地元の電力網からエネルギーを引き出します。ここで物理的なコストが非常に現実的なものになります。そのエネルギーは、ダムであれ、太陽光発電であれ、従来の発電所であれ、どこからか来なければなりません。

サラにはサーバーラックの唸るファンや光るライトは見えませんが、それらは彼女のために懸命に働いています。ニュースレターの草案は数秒で彼女のもとに戻り、彼女は美味しいパンを焼く時間を確保できます。同じプロセスが、世界中で毎日何百万回も繰り返されています。医師がスキャン画像を分析する時も、学生が新しい言語を学ぶ時も、物理的なインフラが彼らを支えています。クリックするたびに、地球規模で連鎖反応が起きるのです。私たちのデジタルライフが、物理的な世界に深く根ざしていることを思い出させてくれます。これらのツールを使って時間を節約するたびに、私たちは巨大な世界規模のマシンとエネルギーのネットワークから恩恵を受けているのです。米国エネルギー省も、こうしたプロセスを誰にとってもより効率的にする方法を模索しています。

現代のデータセンターの規模を考えてみてください。これらの施設は10万m2以上のスペースを占めることもあります。中には何マイルもの銅線や光ファイバーが張り巡らされています。サラにとってはビジネスの向上という恩恵ですが、世界にとっては、日々進化し続ける巨大な工学的偉業なのです。エネルギーを節約するために、寒冷地など自然の冷却効果がある場所にセンターを建設する例も増えています。これは、私たちが自然に逆らうのではなく、自然と協力する方法を学んでいることを示しています。サラがクッキーやケーキ作りに集中できるのは、何千人ものエンジニアや技術者がAIツールの物理的な側面を完璧に維持しているからです。これは人間の創造性と物理的なパワーのパートナーシップなのです。

未来への好奇心

この進歩はすべて素晴らしいものですが、私たちが使うリソースについて素朴な疑問を持つのは自然なことです。これらの巨大なマシンを冷やすのにどれだけの水が必要なのか?古くなったチップは、新しくて速いものに替わったときどうなるのか?これらは怖い問題ではなく、私たちが一緒に解決すべき面白いパズルです。企業がどのように熱を再利用したり、冷却システムで使う水を減らしたりしているかを見てみましょう。また、一般家庭に負担をかけずにこの新しい需要を処理できるよう、電力網をどう強化できるかを考えることも重要です。好奇心を持ってこうした質問を投げかけることで、私たちはテック界をより良く、より思慮深い解決策へと導くことができます。これらすべてが、デジタルな夢と地球の物理的なニーズのバランスを学ぶ旅の一部なのです。

AIに関するストーリー、ツール、トレンド、または取り上げるべき質問がありますか? 記事のアイデアをお送りください — ぜひお聞かせください。ハードウェアの重労働

技術的な詳細が好きな人にとって、AIの物理的な側面は本当に興味深い領域です。私たちは、完璧な調和の中で働く巨大なGPUクラスターについて話しています。これらのクラスターは信じられないほど高速なネットワークケーブルで接続されており、情報をほぼ瞬時に共有できます。最近見られる最大の変化の一つは、カスタムシリコンへの移行です。多くの大手テック企業が、特定のタスクをより効率的にこなすために独自のチップを設計しています。これにより、リクエストごとに必要な総電力を削減できます。また、ローカルストレージやエッジコンピューティングにも大きな注目が集まっています。すべてのデータを遠くの巨大なセンターに送るのではなく、一部のタスクをユーザーの近くで処理するのです。これによりグローバルネットワークへの負荷が軽減され、動作がより高速に感じられます。

もう一つの重要な分野は、「HBM (High Bandwidth Memory)」の開発です。これにより、メモリとプロセッサ間でデータを超高速で移動できるようになります。これがなければ、高速なチップも情報が届くのを待つだけで手一杯になってしまいます。また、こうした物理リソースの使用方法を管理する新しいソフトウェアワークフローも登場しています。現在、APIにより開発者はコードを実行するハードウェアを選択できるようになり、速度やエネルギー効率を最適化できます。物理ハードウェアと、その上で動くコードとの間の複雑なダンスです。目標は常に、1ワットの電力と1グラムのシリコンから最大限の成果を引き出すことです。この効率へのこだわりこそが、無限のリソースを必要とせずに、より大きく優れたツールを作り続けられる理由です。ハードウェアが私たちのワイルドなアイデアに追いついてきている今、テック好きにとっては最高の時代です。

現代のAIを可能にしている主な物理コンポーネントは以下の通りです:

- 大規模な並列処理のための専用GPUクラスター

- データ共有のための高速光ファイバー相互接続

- 熱出力を管理するための高度な液冷システム

- 特定のソフトウェアタスク用に設計されたカスタムAIアクセラレータ

- 電力網の需要のバランスをとるための大規模バッテリーストレージ

ご質問、ご提案、または記事のアイデアがありますか? お問い合わせください。

BotNews.today は、AIツールを使用してコンテンツの調査、執筆、編集、翻訳を行っています。 当社のチームは、情報が有用で明確、信頼できるものであるよう、プロセスをレビューし監督しています。

編集者注: 当サイトは、コンピューターオタクではないものの、人工知能を理解し、より自信を持って使いこなし、すでに到来している未来を追いかけたいと願う人々のための、多言語対応のAIニュースおよびガイドハブとして作成されました。

より明るい明日を築く

結局のところ、AIは人々によって、人々のために、世界の資源を使って作られたツールであることを忘れてはなりません。物理的なコストは現実のものですが、その見返りとして得られる恩恵は本当に刺激的です。私たちは、ハードウェアとエネルギーのグローバルネットワークのおかげで、情報がよりアクセスしやすくなり、タスクが管理しやすくなる未来を築いています。楽観的で好奇心を持ち続けることで、この成長を誰にとっても良い形で継続させることができます。次にスマートアプリを使うときは、あなたのリクエストがたどった信じられないような物理的な旅に、少しだけ思いを馳せてみてください。それは、私たち全員をつなぐ現代工学の小さな奇跡なのです。この強固な物理的基盤の上に、これからも素晴らしいものを築いていきましょう。

AIの物語はまだ書きかけであり、物理的な世界はその大きな一部です。より優れたチップや効率的なデータセンターを構築する新しい方法を見つけるにつれて、私たちは生活を向上させる新しい方法も発見しています。これは私たちが共に歩む旅であり、未来は確かに明るいものです。あなたがテックの専門家であれ、単に新しいアプリを使うのが好きな人であれ、ワクワクすることはたくさんあります。私たちは、進歩の物理的コストを管理可能なものにし、それを地球全体にとってプラスに変えるよう取り組んでいます。この素晴らしい未来を築きながら、これからも一緒に探求し、学んでいきましょう。