AIの本当のリスク、知っておくべきはコレ!

テクノロジーの未来を考えると、まるで何でもありの明るくカラフルな映画を見ているような気分になりますよね。詩を書いたり、カレンダーを整理したり、夢の家をあっという間にデザインしてくれるツールまで登場しています。人工知能(AI)の世界で何が起きているのか、好奇心いっぱいに生きるには本当に素晴らしい時代です。巨大ロボットやSFのようなシナリオを心配する人もいますが、現実はもっと地に足がついていて、正直かなり面白いんですよ。私たちが本当に注目すべきは、恐ろしいモンスターではなく、これらの便利なツールを使うときに私たちが日々行っている小さな選択なんです。こうした実践的なポイントを理解することで、テクノロジーをより良く活用し、デジタルライフをスムーズに保つことができます。これまで以上に速く動く世界で、ワクワクする気持ちと「人間による監視(human oversight)」の完璧なバランスを見つけることがすべてなんです。

本当に重要なリスクについて話すとき、私たちはこれらのシステムが時々ちょっと自信過剰になってしまう点に注目しています。何でも手伝ってくれる、すごく優秀なアシスタントがいると想像してみてください。このアシスタントは超優秀で、世の中のほとんどすべての本を読破していますが、あなたのように世界を本当に理解しているわけではありません。彼らはパターンに基づいて、文中の次の単語を推測するのがめちゃくちゃ得意なだけなんです。時々、アシスタントは完璧に正しそうに聞こえる答えを出すかもしれませんが、それは実はとても丁寧な「推測」に過ぎません。これを専門家は「ハルシネーション(hallucination)」と呼んでいます。AIがあなたを騙そうとしているわけではなく、ただひたすら役に立ちたい一心で、創造的だけど間違った詳細で空白を埋めてしまうことがあるんです。Google AdsやSEOにAIを使っている人にとって、これは「公開」ボタンを押す前に、常に事実をダブルチェックする必要がある、ということですね。

エラーを見つけたり、修正が必要な点がありましたか? お知らせください。これを別の角度から考えると、すごくおしゃれなキッチン家電を使っているようなものです。野菜を一瞬でみじん切りにしてくれるから、時間短縮にはめちゃくちゃ役立ちます。でも、刃のセットを間違えたり、本来処理できないものを入れたりすると、ちょっとした大惨事になることもありますよね。ここでのリスクは、その家電がキッチンを乗っ取るということではなく、それに頼りすぎて普通の包丁の使い方も忘れちゃうかもしれない、ということです。コンテンツ作成の世界では、私たち自身のユニークな「味」やストーリーをちゃんと提供し続けることが大切です。AIはブレインストーミングや思考の整理には最高のパートナーですが、メッセージの「心」は、常にオーディエンスを理解している生身の人間から生まれるべきです。そうすることで、みんなが言っていることの繰り返しではなく、私たちの作品が常に新鮮で「本物(authentic)」だと感じられるように保てるんです。

これらのツールの影響は本当にグローバルで、これまで考えられなかった方法で多くの人々を結びつけています。世界中のあちこちにいる中小企業のオーナーが、AIを使ってウェブサイトを何十もの言語に翻訳できるようになり、これまで話すことのできなかった顧客にリーチできるようになりました。これは本当に嬉しい進展で、高コストや言語の壁によって閉ざされていた創造性や貿易の扉を開いてくれます。小さな町の職人さんが、何千マイルも離れた人に手作りの商品を簡単に売れるようになるということです。これに対する興奮は計り知れません。なぜなら、莫大な予算を持つ大企業だけでなく、すべての人にとって「競争の場(playing field)」を平等にしてくれるからです。大局的に見ると、これらのツールが世界を少し小さく、より「つながっている(connected)」と感じさせる方法に焦点が当たっています。

しかし、このグローバルなリーチには、私たちが一緒に考えるべき点がいくつかあります。みんなが同じツールを使って広告を書いたり、ソーシャルメディアの投稿を作成し始めると、すべてが少し似たような見た目やサウンドになり始める可能性が少しあります。私たちはこれを「デジタルベージュ(digital beige)」のリスクと呼んでいます。もし私たちがみんな同じAIのSEO提案に従ってしまうと、インターネットをこんなに楽しい場所にしてくれている、私たちの地域文化の風変わりでカラフルな部分を失ってしまうかもしれません。私たちの「ローカルな声(local voices)」を大きくはっきりと保つことが重要です。これらのツールを使いながら、物事を面白く保つためのいくつかの方法をご紹介します。

- AIが知らないかもしれない個人的なストーリーや地元のジョークを加えてみる。

- AIを使ってデータを見つけるのはいいけど、最終的な「ヘッドライン(headline)」は自分で書く。

- AIに5つの異なる視点を聞いてみて、一番自分らしいと感じるものを選ぶ。

- 異なるツールからの提案を「ミックス&マッチ(mix and match)」して、まったく新しいものを作り出す。

これが現実世界でどう機能するのか、サラという人のある一日を覗いてみましょう。サラは、エコフレンドリーなガーデニング用品を販売する小さなオンラインショップを経営しています。毎朝、彼女はAIツールを使って購読者向けのニュースレターの下書きを作成しています。これで約2時間のタイピング時間を節約できるのは素晴らしいこと。その時間を実際に注文を梱包したり、植物と話したりすることに使えるんですからね。ある日、AIは彼女の顧客に「特定の花は雪の中で最もよく育つ」と伝えるよう提案しました。サラはそれが真実ではないことを知っていたので、笑ってしまいました。もし彼女が読まずに「送信」をクリックしていたら、顧客はかなり混乱したかもしれません。彼女はその間違いを修正し、「おかしなAIアシスタント」についての面白いメモを添えたところ、顧客はその正直さをとても気に入ってくれました。これは、注意を払っていればリスクはほんの小さな「つまずき(bump in the road)」に過ぎない、という素晴らしい例です。

サラはGoogle Adsの管理にもAIを活用しています。このツールは、人々が彼女のショップをより簡単に見つけられるような「キーワード(keywords)」を提案してくれます。ここでのリスクは、ツールが非常に高価だけど実際には売上につながらないキーワードを提案してしまうことがある点です。予算をしっかり監視し、数日ごとに「レポート(reports)」をチェックすることで、サラは自分のお金を最大限に活用していることを確認しています。彼女はAIを、計算は得意だけど食費の予算をどう使うかについては少し guidance が必要なパートナーのように扱っています。この「プロアクティブ(proactive)」なアプローチは、潜在的なリスクをシンプルな管理タスクに変えてくれます。それはまるで、AIが旅の長くまっすぐな部分で「オートパイロット(autopilot)」を処理している間、あなたが飛行機の「パイロット(pilot)」であるようなものです。彼女が売上成功の通知を受け取るとき、人間らしい「タッチ(touch)」が違いを生んだことを知るのです。

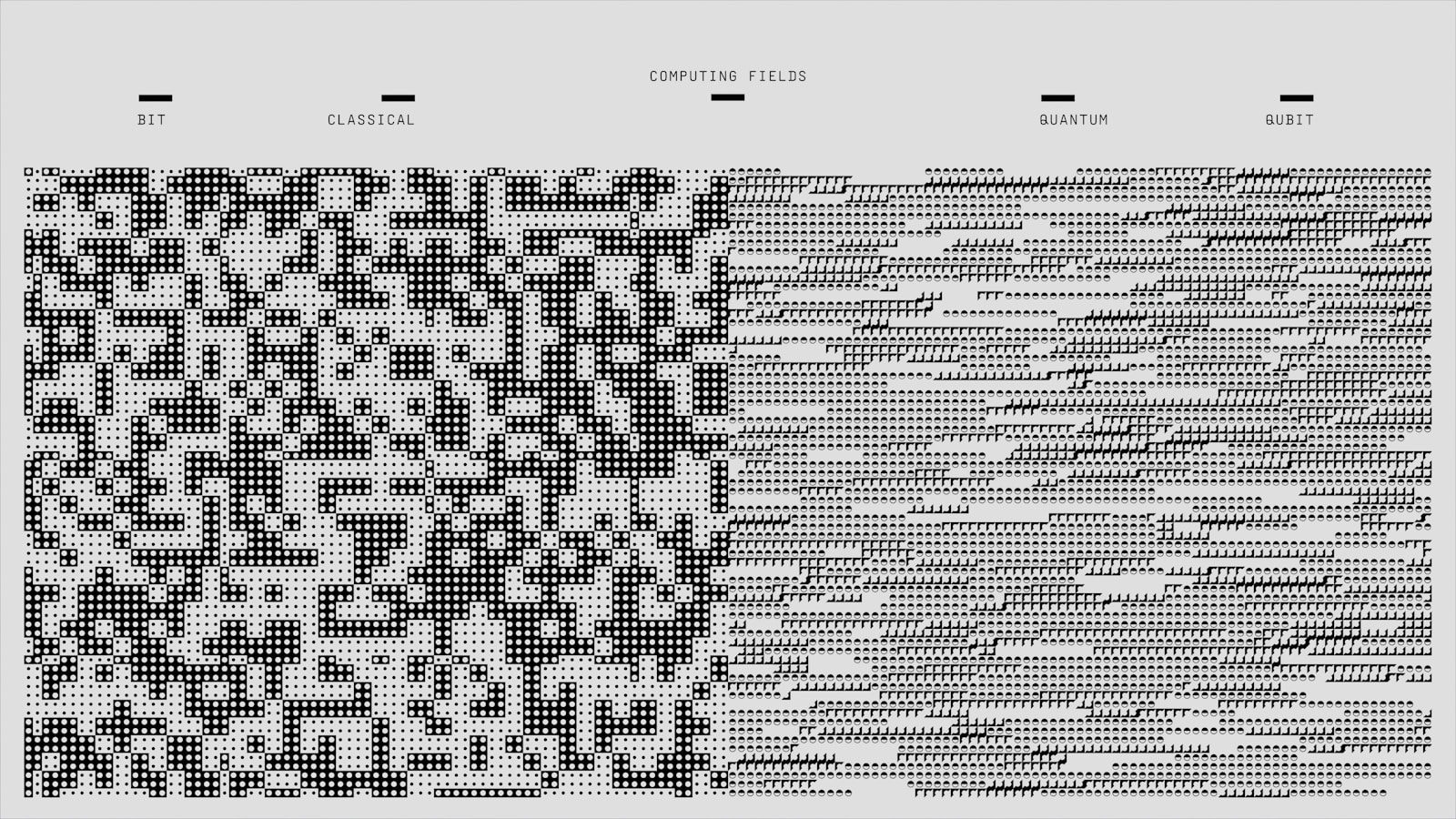

これらの新しい「おもちゃ(toys)」を楽しんでいると、舞台裏でまだ解決策が模索されていることについて疑問に思うかもしれません。例えば、これらの巨大な「コンピューターの脳(computer brains)」を動かすのに必要な膨大なエネルギーが、私たちの美しい地球を傷つけないようにするにはどうすればいいのでしょうか?これは興味深い疑問です。なぜなら、自然に大きな負担をかけることなく、迅速な答えという恩恵を得たいからです。また、私たちの「データ(data)」がこれらのシステムを「トレーニング(train)」するためにどのように使われているか、そして役に立ちながらもプライバシーを保つ方法を見つけられるか、という議論もあります。これらは悲しんだり心配したりする理由ではなく、むしろ世界中の最も賢い人々が一緒に解決すべき興味深い「パズル(puzzles)」なんです。今これらの問いを投げかけることで、私たちは次の世代のために、テクノロジーの未来が私たちが望むように明るくクリーンであることを確実にしているのです。

AIに関するストーリー、ツール、トレンド、または取り上げるべき質問がありますか? 記事のアイデアをお送りください — ぜひお聞かせください。詳細に踏み込むのが好きな人にとって、これらのツールを私たちの「ワークフロー(workflows)」に統合する方法こそが、本当の「マジック(magic)」が起こる場所です。多くの人が今、「API接続(API connections)」を使ってお気に入りの「アプリ(apps)」をAI「モデル(models)」に直接リンクさせることを検討しています。これにより情報の流れがはるかにスムーズになりますが、「レートリミット(rate limits)」や「トークンコスト(token costs)」といったものも伴います。「トークン(token)」は基本的に単語の小さな塊で、AIが考えるたびに、これらのトークンの一部を消費します。もし大きな「プロジェクト(project)」を構築しているなら、予算を超えないようにどれくらいのトークンを使っているかに気を配る必要があります。それは携帯電話の「データプラン(data plan)」を持っているようなものです。重要なことに使いたいし、必要ないときは「バックグラウンド(background)」で動かしっぱなしにはしたくないですよね。

BotNews.today は、AIツールを使用してコンテンツの調査、執筆、編集、翻訳を行っています。 当社のチームは、情報が有用で明確、信頼できるものであるよう、プロセスをレビューし監督しています。

「パワーユーザー(power users)」にとってもう一つクールなのは、「ローカルストレージ(local storage)」や、自分の「ハードウェア(hardware)」でモデルを動かす動きです。これは情報があなたのコンピューターから決して離れないため、「プライバシー(privacy)」を扱う上で素晴らしい方法です。かなり強力な「グラフィックカード(graphics card)」といくつかの技術的な「セットアップ(setup)」が必要ですが、日々アクセスしやすくなっています。また、「RAG(Retrieval-Augmented Generation)」と呼ばれる分野でも大きな成長が見られます。これは、AIが質問に答える前に、あなた自身の特定のドキュメントセットを読ませる、というちょっとおしゃれな言い方です。これにより、AIが何かをでっち上げる可能性が劇的に減ります。なぜなら、すべての答えに対して参照すべき特定の「本」があるからです。これは、先に話した「精度リスク(accuracy risks)」を管理する上で非常に効果的な方法です。今、「ギーク(geeks)」たちが注目していることをいくつかご紹介します。

- AIがより長い会話を記憶できるように「コンテキストウィンドウ(context windows)」を最適化する。

- AIがほぼ瞬時に応答するように「レイテンシー(latency)」を削減する。

- AIがどれくらい創造的か、あるいは文字通りかを制御するために、さまざまな「温度設定(temperature settings)」をテストする。

- 「出力(output)」を安全に、かつ「ブランド(brand)」に沿ったものに保つためのカスタム「ガードレール(guardrails)」を構築する。

編集者注: 当サイトは、コンピューターオタクではないものの、人工知能を理解し、より自信を持って使いこなし、すでに到来している未来を追いかけたいと願う人々のための、多言語対応のAIニュースおよびガイドハブとして作成されました。

「テック(tech)」の世界は常に進化しており、情報を得続けることがこの「ライド(ride)」を楽しむ最善の方法です。これらのトピックに関するさらなる最新情報は、MIT Technology Reviewの最新レポートをチェックしたり、OpenAIのチームが次に何に取り組んでいるかを見たりすることで見つけられます。これが私たちの社会にどう影響するかをより広く見るには、Stanford HAIが本当に思慮深い「リサーチ(research)」を提供しています。最新のAIニュースとトレンドを追いかけることも、「時代の最先端(ahead of the curve)」を行く素晴らしい方法です。AIが何ができて、何をすべきかについての議論はまだ大きく開かれており、それが最もエキサイティングな部分です。私たちは、これらのツールが私たちの生活やビジネスにどう適合するかを決定するグループの一員になれるんです。

ご質問、ご提案、または記事のアイデアがありますか? お問い合わせください。結局のところ、最大のリスクは、少しの好奇心と友好的な態度があれば、私たちが完全に「ハンドル(handle)」できることばかりです。テクノロジーをどう使うかについて「賢い選択(smart choices)」をするのに、専門家である必要はありません。関わり続け、質問をすることで、AIが私たちの生活をより簡単で楽しいものにする、役立つ友達であり続けることを確実にします。未来は本当に明るく見えますし、誰もが成長し成功するための余地がたくさんあります。探求し続け、学び続け、私たち自身のユニークなストーリーを世界と共有し続けましょう。結局のところ、どんなテクノロジーにとっても最高の部分は、人々を結びつけ、素晴らしいものを作り出す方法です。このグローバルな「コミュニティ(community)」の一員となり、私たちの想像力が次にどこへ連れて行ってくれるかを見るのは、素晴らしい時間です。