A legfontosabb katonai AI-kérdések 2026-ben

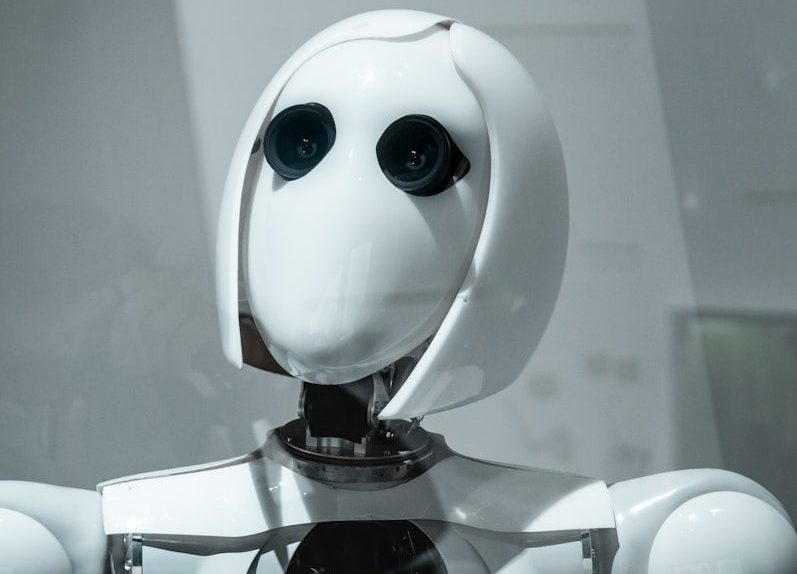

Vége annak az időszaknak, amikor arról vitáztunk, hogy az AI-nak van-e helye a csatatéren. A kormányok már aláírják a szerződéseket. A beszerzés a kísérleti laborokból átkerült a szabványos védelmi megállapodások világába. Ez a változás az AI-t futurisztikus koncepcióból a nemzeti költségvetések állandó tételévé emelte. A fókusz már nem az öntudattal rendelkező robotokon, hanem a nagy léptékű adatfeldolgozáson van. A katonai vezetők olyan rendszereket akarnak, amelyek gyorsabban azonosítják a célpontokat, mint bármely ember. Olyan szoftvereket keresnek, amelyek előre jelzik a logisztikai hibákat. Ez az átmenet új valóságot teremt a globális biztonság számára, és arra kényszerít minket, hogy újragondoljuk a háborúk kezdetét és végét. A döntéshozatal sebessége túllépi az emberi kognitív képességeket. Itt nem sci-firől van szó, hanem a machine learning azonnali integrációjáról a már létező szenzorokba és fegyverrendszerekbe. A tét nem csupán a hardver, hanem a nemzetközi stabilitás alapvető logikája. Az elkövetkező évek döntései évtizedekre meghatározzák a világ biztonságát. Az etikai retorika találkozik a verseny valóságával.

A laboratóriumtól a költségvetési sorig

A katonai AI lényegében a machine learning alkalmazása a hagyományos védelmi funkciókban. Ez nem egyetlen találmány, hanem képességek gyűjteménye. Ide tartozik a drónok feedjeihez használt computer vision, az elfogott jelekhez alkalmazott natural language processing és a földi járművek autonóm navigációja. Korábban ezek kutatási projektek voltak, ma már a beszerzési kérelmek alapkövetelményei. A cél a szenzorok fúziója: a műholdakról, radarokról és a katonáktól érkező adatok egyesítése egyetlen képpé. Amikor egy rendszer másodpercenként több millió adatpontot dolgoz fel, olyan mintázatokat ismer fel, amelyeket egy emberi elemző elszalasztana. Ezt gyakran algorithmic warfare-nek nevezik. A módszer a történelmi harci és terepi adatok hatalmas halmazán alapuló modellek betanításán nyugszik. A szoftveralapú védelem felé történő elmozdulás azt jelenti, hogy egy tank vagy egy vadászgép csak annyira jó, mint a benne futó kód. Ez megváltoztatja a hardvergyártást: a hagyományos páncélzat vagy sebesség helyett a compute power és az adatátviteli sebesség élvez prioritást. A modern beszerzés arra fókuszál, milyen könnyen kaphat egy rendszer over the air frissítést. Ha egy modell elavul, a hardver teherré válik. Ezért udvarolnak a védelmi minisztériumok a Silicon Valley-nek; szükségük van a kereskedelmi szoftverfejlesztés agilitására, hogy lépést tartsanak az ellenfelekkel. A prototípus és a bevethető rendszer közötti szakadék szűkül. A szoftver-első katonaság korát éljük, ahol minden, a bérszámfejtéstől az alkatrész-menedzsmentig, adatproblémává válik.

Globális súrlódások és az új fegyverkezési verseny

Az átmenet globális hatása egyenetlen. Míg az Egyesült Államok és Kína vezeti a beruházásokat, más nemzetek kénytelenek választani a saját rendszerek fejlesztése vagy a vezetőktől való vásárlás között. Ez új függőségeket teremt. Aki AI-vezérelt drónflottát vásárol, az megveszi a szállító adatcsatornáit és tréningmodelljeit is. Ez a soft power egy új formája, és az instabilitás forrása. Amikor két AI-vezérelt erő néz szembe egymással, a véletlen eszkaláció kockázata nő. A gépek olyan sebességgel reagálnak, amely nem teszi lehetővé az emberi diplomáciát. Ha egy rendszer egy gyakorlatot támadásnak vél, a válaszreakció milliszekundumokon belül bekövetkezik, ami drasztikusan csökkenti a vezetők rendelkezésére álló időt a deeszkalációra. A retorika és a bevetés közötti szakadék is kulcstényező: a vezetők nyilvánosan az emberi kontrollról beszélnek, de a beszerzési logika a versenyképesség érdekében több autonómiát követel. Nem lehet ember a hurokban, ha az ellenséges rendszer tízszer gyorsabb. Ez a biztonsági szabványok leépüléséhez vezet. A globális váltás az alábbi területeket érinti leginkább:

- Nemzeti szuverenitás az adatok és a védelmi algoritmusok felett.

- A nukleáris elrettentés stabilitása a gyors döntéshozatal korában.

- Gazdasági szakadék a technológia-intenzív és a hagyományos hadseregek között.

- A nemzetközi konfliktusokat és háborús bűnöket szabályozó jogi keretek.

- A magánvállalatok szerepe a nemzetbiztonsági döntésekben.

A kis nemzetek különösen sebezhetőek, tesztpályákká válhatnak az új technológiák számára. Az innováció sebessége meghaladja a nemzetközi testületek szabályalkotási képességét, így vákuum keletkezik, ahol a legerősebb technológia győz, függetlenül a jogi költségektől. Ezt tükrözi a legfrissebb védelmi jelentés, amely kiemeli az autonóm rendszerek gyors elterjedését az aktív konfliktusövezetekben.

Egy kedd a beszerzési irodában

Képzeljük el Sarah-t, aki egy modern védelmi minisztériumban dolgozik 2026-ben. Napja nem új puskák terveinek átnézésével telik, hanem cloud service megállapodások és API dokumentációk elemzésével. El kell döntenie, melyik computer vision modellt vásárolja meg egy új megfigyelő drónflottához. Az egyik gyártó 99 százalékos pontosságot ígér, de állandó kapcsolatot igényel egy központi szerverrel. A másik 85 százalékot kínál, de teljesen a drónon fut. Sarah tudja, hogy egy valódi konfliktusban a szerverkapcsolatot zavarni fogják. Délben adatjogi értekezleten vesz részt: a gyártó meg akarja tartani a drónok által gyűjtött adatokat a jövőbeli modellek tanításához. Sarah tudja, hogy ez biztonsági kockázat: ha a céget feltörik, az ellenség pontosan tudni fogja, mit láttak a drónok. Ez a katonai tervezés új arca, a teljesítmény és a biztonság közötti állandó kompromisszum. A beszerzési ciklus felgyorsítására irányuló nyomás óriási; a felettesek a legújabb technológiát akarják, nem öt év múlva. Délután Sarah a modellek driftjéről szóló jelentést olvassa: az AI, amelynek járműveket kellett volna azonosítania, kezd hibázni, mert a környezet megváltozott. A évszakok váltakozása és az árnyékok mássága megzavarja a gépet a sárban. Sarah-nak meg kell találnia a módját, hogy a modelleket a terepen frissítse a hálózat veszélyeztetése nélkül. Ez nem videójáték, hanem logisztikai rémálom. Egyetlen kódhiba baráti tűzhöz vagy egy fenyegetés elszalasztásához vezethet. A nap végére Sarah már nem biztos benne, hogy fegyvert vagy előfizetéses szolgáltatást vásárol-e. A védelmi vállalkozó és a szoftverszolgáltató közötti határ elmosódott. Ezt mindenki érzi a gyárpadlótól a frontvonalig. A katonáknak most egy doboznyi áramkörben kell bízniuk, hogy megmondja, ki barát és ki ellenség. E váltás pszichológiai hatását csak most kezdik megérteni.

A BotNews.today mesterséges intelligencia eszközöket használ a tartalom kutatására, írására, szerkesztésére és fordítására. Csapatunk felülvizsgálja és felügyeli a folyamatot, hogy az információ hasznos, világos és megbízható maradjon.

Az algoritmikus bizalom rejtett költségei

Nehéz kérdéseket kell feltennünk az átmenet rejtett költségeiről. Mi történik az elszámoltathatósággal, ha egy gép hibázik? Ha egy autonóm rendszer civil célpontot talál el, ki a felelős? A programozó, a beszerzési tiszt vagy a parancsnok, aki bekapcsolta? A jelenlegi jogi keretek nincsenek erre felkészülve. Ott van a magánszféra kérdése is: a katonai megfigyelő AI nem áll meg a határoknál. Ugyanaz a technológia, amellyel a lázadókat követik, felhasználható a lakosság megfigyelésére is. Az AI kettős felhasználású természete azt jelenti, hogy minden katonai fejlesztés potenciális eszköz az állami megfigyeléshez. Figyelembe kell vennünk az adatok költségét is: a modellek tanítása hatalmas mennyiségű energiát és vizet igényel a szerverparkokban. Ezek a környezeti költségek ritkán szerepelnek a védelmi költségvetésben. Ott van a black box döntéshozatal kockázata is. Ha egy tábornok nem tudja megmagyarázni, miért javasolt az AI egy konkrét csapást, bízhatunk-e a javaslatban? A deep learning modellek átláthatatlansága alapvető hiba katonai kontextusban. Olyan rendszereket építünk, amelyeket nem értünk teljesen, ami törékeny biztonsági környezetet teremt. Ha egy ellenfél megtalálja a módját, hogy megmérgezze a tanító adatokat, lövés nélkül legyőzheti a rendszert. Ez egy újfajta sebezhetőség. Hogyan ellenőrizzük, hogy egy modellt nem manipuláltak-e? Hogyan biztosítjuk, hogy az AI a háború káoszában is összhangban maradjon az emberi értékekkel? Ezek nem csupán technikai, hanem erkölcsi és egzisztenciális problémák. Az AI bevetésére irányuló rohanás több problémát okozhat, mint amennyit megold. Az emberi ítélőképességet cseréljük le a gép sebességére, de közben elveszíthetjük a következmények feletti kontrollt. Olyan szervezetek, mint a Brookings Institution, folyamatosan figyelmeztetnek ezekre a problémákra.

A taktikai következtetés háttere

A katonai AI technikai valósága a költségvetés „geek” szekciójában rejlik. Ez az inference at the edge, azaz a komplex modellek futtatása kis, strapabíró hardvereken, felhőkapcsolat nélkül. A mérnökök a modellek optimalizálására fókuszálnak, hogy azok elférjenek egy drón vagy kézi eszköz korlátozott memóriájában. Olyan technikákat használnak, mint a kvantálás és a metszés (pruning), hogy zsugorítsák a neurális hálózatokat. Az API-korlátok komoly gondot jelentenek azoknál a rendszereknél, amelyeknek a hadsereg különböző ágai között kell kommunikálniuk. Ha a haditengerészeti AI nem tud beszélni a légierő AI-jával egy zárt interfész miatt, a rendszer megbukik. Ez vezetett a katonai szoftverek nyílt szabványai iránti törekvéshez. A helyi adattárolás egy másik akadály: egyetlen megfigyelő repülés terabájtnyi adatot generálhat. Ezen adatok helyi feldolgozása elengedhetetlen, mivel a sávszélesség korlátozott a harci zónákban. A hardvernek MIL-SPEC minősítésűnek kell lennie, azaz bírnia kell az extrém hőt, a vibrációt és az elektromágneses impulzusokat. A vállalatok most azért versengenek, hogy biztosítsák azokat a chipeket és adatintegrációs rétegeket, amelyek lehetővé teszik az algorithmic warfare-t. A munkafolyamat több lépésből áll:

- Adatbevitel heterogén szenzorhálózatokból.

- Eszközön belüli előfeldolgozás a zaj kiszűrésére.

- Következtetés (inference) alacsony késleltetésű neurális motorokkal.

- Végrehajtható kimenet biztosítása az ember-gép interfészen.

- Küldetés utáni adatvisszatöltés a modellek újratanításához.

A korlát gyakran nem az algoritmus, hanem az akkumulátor élettartama és a hardver hőelvezetése. Ahogy a modellek nőnek, az energiaigény is nő, ami plafont szab a frontvonalon bevethető eszközöknek. A mérnökök most speciális ASIC-eket keresnek a megoldáshoz. Ezek a chipek egyetlen feladatra, például objektumfelismerésre lettek tervezve, és sokkal hatékonyabbak az általános célú processzoroknál. Itt zajlik az igazi verseny: a hatékonyság és a hőkezelés csatája. Ezekről a hardveres kihívásokról a New York Times technológiai rovatában olvashat bővebben.

A végső küszöb kérdése

A lényeg az, hogy a katonai AI már nem választás kérdése, hanem strukturális valóság. A kísérleti technológiából a központi beszerzésbe való átmenet az elmúlt években zajlott le. Ez a fókuszt arról, hogy „kell-e használnunk az AI-t”, arra helyezte, hogy „hogyan tudjuk kontrollálni”. A szakadék a közvélemény által elképzelt és a valós események között széles. Az emberek sci-fi robotokra számítanak, de a valóság minden szenzor és rádió csendes, adatvezérelt átalakulása. A legjelentősebb kockázat nem egy elszabadult AI, hanem egy gyors eszkaláció, amelyet egyetlen ember sem tud megállítani. Ahogy ezeket a rendszereket egyre mélyebben integráljuk parancsnoki struktúráinkba, egy utolsó kérdést kell feltennünk: hol van az a határ, amelyet soha nem engedünk átlépni egy gépnek? 2026-ig ez a határ még mindig nincs meghatározva.

A szerkesztő megjegyzése: Ezt az oldalt többnyelvű AI hírek és útmutatók központjaként hoztuk létre olyan emberek számára, akik nem számítógépes zsenik, de mégis szeretnék megérteni a mesterséges intelligenciát, magabiztosabban használni, és követni a már megérkező jövőt.

Hibát talált, vagy valami javításra szorul? Tudassa velünk.