As questões mais importantes sobre IA militar hoje

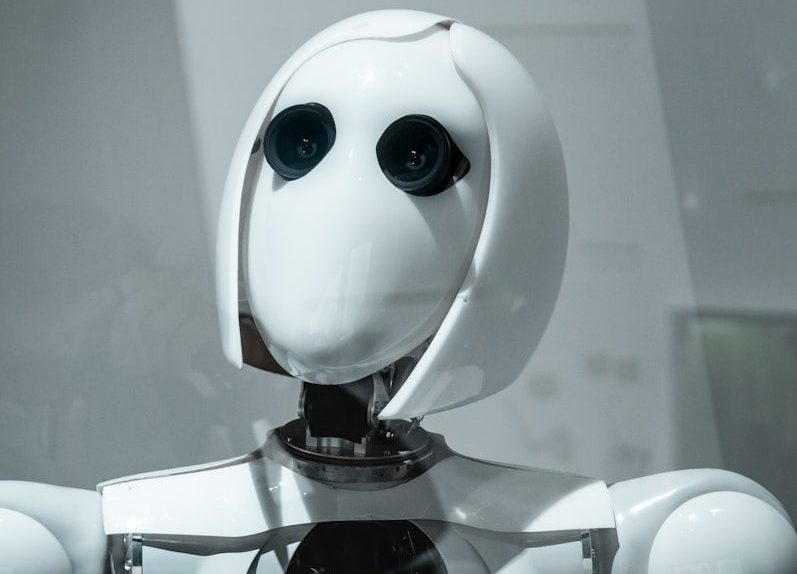

A era de debater se a IA pertence ao campo de batalha acabou. Os governos já estão assinando os cheques. A aquisição mudou de laboratórios experimentais para contratos de defesa padrão. Essa mudança transforma a IA de um conceito futurista em um item fixo nos orçamentos nacionais. O foco não está mais em robôs sencientes, mas no processamento de dados em escala. Os líderes militares querem sistemas que identifiquem alvos mais rápido do que qualquer humano. Eles buscam softwares que prevejam falhas logísticas antes que aconteçam. Essa transição cria uma nova realidade para a segurança global. Ela força uma reflexão sobre como as guerras começam e terminam. A velocidade da tomada de decisão está superando a cognição humana. Não se trata de ficção científica. Trata-se da integração imediata de machine learning nos sensores e sistemas de disparo que já existem. O que está em jogo envolve mais do que apenas hardware; envolve a lógica fundamental da estabilidade internacional. As decisões tomadas nos próximos anos ditarão a segurança do mundo por décadas. A retórica da ética está encontrando a realidade da competição.

A mudança do laboratório para o orçamento

A IA militar é, essencialmente, a aplicação de machine learning às funções tradicionais de defesa. Não é uma invenção única, mas um conjunto de capacidades. Isso inclui computer vision para feeds de drones, processamento de linguagem natural para sinais interceptados e navegação autônoma para veículos terrestres. No passado, eram projetos de pesquisa. Hoje, são requisitos em solicitações de propostas. O objetivo é a fusão de sensores. Isso significa pegar dados de satélites, radares e soldados em campo e combiná-los em uma única imagem. Quando um sistema processa milhões de pontos de dados em um segundo, ele identifica padrões que um analista humano poderia perder. Isso é frequentemente chamado de guerra algorítmica. Ela depende da capacidade de treinar modelos em datasets massivos de informações históricas de combate e terreno. A mudança para uma defesa definida por software significa que um tanque ou um jato é tão bom quanto o código que roda dentro dele. Isso muda a forma como as empresas constroem hardware. Elas agora devem priorizar poder de processamento e throughput de dados em vez de blindagem ou velocidade tradicional. A aquisição moderna foca em quão facilmente um sistema pode receber um update over the air. Se um modelo se torna obsoleto, o hardware vira um passivo. É por isso que os departamentos de defesa estão cortejando o Silicon Valley. Eles precisam da agilidade do desenvolvimento de software comercial para se manterem à frente dos adversários. A distância entre um protótipo e um sistema implantado está diminuindo. Estamos vendo a ascensão da força militar software-first. Esse movimento não é apenas sobre armas, mas sobre todo o backend da máquina militar, desde a folha de pagamento até a gestão de peças. Cada aspecto da organização está se tornando um problema de dados.

Atrito global e a nova corrida armamentista

O impacto global dessa transição é desigual. Enquanto os Estados Unidos e a China lideram o investimento, outras nações são forçadas a escolher entre desenvolver seus próprios sistemas ou comprar dos líderes. Isso cria novas dependências. Uma nação que compra uma frota de drones movida a IA também está comprando o pipeline de dados e os modelos de treinamento do fornecedor. Essa é uma nova forma de soft power e também uma fonte de instabilidade. Quando duas forças impulsionadas por IA se enfrentam, o risco de escalada acidental aumenta. Máquinas reagem em velocidades que não permitem a diplomacia humana. Se um sistema interpreta um exercício de treinamento como um ataque, a contra-resposta acontece em milissegundos. Isso comprime o tempo disponível para os líderes conversarem e desescalarem. A lacuna entre retórica e implantação também é um fator importante. Líderes frequentemente falam sobre controle humano significativo em público. No entanto, a lógica de aquisição exige mais autonomia para permanecer competitivo. Você não pode ter um humano no loop se o sistema inimigo for dez vezes mais rápido. Isso cria uma corrida para o fundo em termos de padrões de segurança. As áreas a seguir são as mais afetadas por essa mudança global:

- Soberania nacional sobre dados e algoritmos de defesa.

- A estabilidade da dissuasão nuclear em uma era de tomada de decisão rápida.

- A divisão econômica entre forças militares com muita tecnologia e as tradicionais.

- As estruturas legais que regem conflitos internacionais e crimes de guerra.

- O papel de corporações privadas nas decisões de segurança nacional.

Nações pequenas são particularmente vulneráveis. Elas podem se tornar campos de teste para novas tecnologias. A velocidade da inovação supera a capacidade dos órgãos internacionais de criar regras. Isso deixa um vácuo onde a tecnologia mais forte vence, independentemente do custo legal. Isso é refletido no relatório de defesa mais recente, que destaca a rápida adoção de sistemas autônomos em zonas de conflito ativo.

Uma terça-feira no escritório de aquisições

Imagine uma oficial de aquisições chamada Sarah trabalhando em um ministério de defesa moderno em 2026. Seu dia não envolve olhar plantas de novos rifles. Em vez disso, ela passa a manhã revisando contratos de serviços de cloud e documentação de API. Ela precisa decidir qual modelo de computer vision comprar para uma nova frota de drones de vigilância. Um fornecedor promete uma taxa de precisão de 99%, mas exige conexão constante a um servidor central. Outro oferece 85% de precisão, mas roda inteiramente no próprio drone. Sarah sabe que, em um conflito real, a conexão com o servidor será bloqueada. Ela precisa pesar o custo da precisão contra a realidade do campo de batalha. Ao meio-dia, ela está em uma reunião sobre direitos de dados. A empresa que fornece a IA quer manter os dados que os drones coletam para treinar seus futuros modelos. Sarah sabe que isso é um risco de segurança. Se a empresa for hackeada, o inimigo saberá exatamente o que os drones viram. Esta é a nova face do planejamento militar. É uma troca constante entre performance e segurança. A pressão para acelerar o ciclo de aquisição é imensa. Seus superiores querem a tecnologia mais recente agora, não daqui a cinco anos. Eles veem o que está acontecendo em conflitos atuais, onde drones baratos e softwares inteligentes estão superando sistemas legados caros. À tarde, Sarah revisa um relatório sobre model drift. A IA que deveria identificar veículos está começando a falhar porque o ambiente mudou. As estações mudaram e as sombras estão diferentes. A máquina está confusa com a lama. Sarah precisa encontrar uma maneira de atualizar os modelos em campo sem expor a rede. Isso não é um videogame; é um pesadelo logístico de alto risco. Um único erro no código pode levar a um incidente de fogo amigo ou a uma ameaça ignorada. No final do dia, Sarah não tem certeza se está comprando uma arma ou um serviço de assinatura. A linha entre um contratante de defesa e um provedor de software desapareceu. Essa mudança é sentida por todos, do chão de fábrica às linhas de frente. Os soldados agora precisam confiar em uma caixa de circuitos para dizer quem é amigo e quem é inimigo. O impacto psicológico dessa mudança está apenas começando a ser compreendido.

BotNews.today utiliza ferramentas de IA para pesquisar, escrever, editar e traduzir conteúdo. Nossa equipe revisa e supervisiona o processo para manter as informações úteis, claras e confiáveis.

Os custos ocultos da confiança algorítmica

Devemos fazer perguntas difíceis sobre os custos ocultos dessa transição. O que acontece com a responsabilidade quando uma máquina comete um erro? Se um sistema autônomo atinge um alvo civil, quem é responsabilizado? É o programador, o oficial de aquisições ou o comandante que o ligou? As estruturas legais atuais não estão preparadas para isso. Há também a questão da privacidade. A IA de vigilância militar não para na fronteira. A mesma tecnologia usada para rastrear insurgentes pode ser usada para monitorar populações domésticas. A natureza de duplo uso da IA significa que cada avanço militar é uma ferramenta potencial para vigilância estatal. Também devemos considerar o custo dos dados. Treinar esses modelos requer quantidades massivas de energia e água para data centers. Esses custos ambientais raramente são incluídos no orçamento de defesa. Existe também o risco da tomada de decisão em caixa preta. Se um general não consegue explicar por que uma IA recomendou um ataque específico, podemos confiar na recomendação? A falta de transparência em modelos de deep learning é uma falha fundamental em um contexto militar. Estamos construindo sistemas que não compreendemos totalmente. Isso cria um ambiente de segurança frágil. Se um adversário encontrar uma maneira de envenenar os dados de treinamento, ele pode derrotar o sistema sem disparar um tiro. Esse é um novo tipo de vulnerabilidade. Como verificamos que um modelo não foi adulterado? Como garantimos que a IA permaneça alinhada aos valores humanos durante o caos da guerra? Esses não são apenas problemas técnicos; são morais e existenciais. A pressa para implantar a IA pode estar criando mais problemas do que resolvendo. Estamos trocando o julgamento humano pela velocidade da máquina, mas podemos estar perdendo o controle sobre as consequências. Organizações como a Brookings Institution continuam a soar o alarme sobre essas questões.

Por dentro da inferência tática

A realidade técnica da IA militar é encontrada na seção geek do orçamento. Trata-se de inference at the edge. Isso significa rodar modelos complexos em hardware pequeno e robusto, sem conexão com a cloud. Engenheiros estão focados em otimizar modelos para caber na memória limitada de um drone ou dispositivo portátil. Eles usam técnicas como quantização e poda para reduzir o tamanho das redes neurais. Limites de API são uma grande preocupação para sistemas que precisam se comunicar entre diferentes ramos das forças armadas. Se a IA da Marinha não consegue falar com a IA da Força Aérea devido a uma interface proprietária, o sistema falha. Isso levou a um impulso por padrões abertos em software militar. O armazenamento local é outro obstáculo. Um único voo de vigilância pode gerar terabytes de dados. Processar esses dados localmente é essencial porque a largura de banda é limitada em uma zona de combate. O hardware também deve ser MIL-SPEC, o que significa que pode sobreviver a calor extremo, vibração e pulsos eletromagnéticos. Empresas agora competem para fornecer os chips e as camadas de integração de dados que tornam a guerra algorítmica possível. O fluxo de trabalho envolve várias etapas específicas:

- Ingestão de dados de matrizes de sensores heterogêneos.

- Pré-processamento no dispositivo para filtrar ruído.

- Inferência usando motores neurais de baixa latência.

- Saída acionável entregue a uma interface humano-máquina.

- Backhaul de dados pós-missão para retreinamento de modelos.

A limitação geralmente não é o algoritmo, mas a vida útil da bateria e a dissipação de calor do hardware. À medida que os modelos crescem, os requisitos de energia aumentam. Isso cria um teto para o que pode ser implantado nas linhas de frente. Engenheiros agora estão olhando para ASICs especializados para resolver isso. Esses chips são projetados para uma tarefa, como detecção de objetos, e são muito mais eficientes do que processadores de uso geral. É aqui que a verdadeira corrida está acontecendo. É uma batalha de eficiência e gerenciamento térmico. Você pode ler mais sobre esses desafios de hardware na seção de tecnologia do New York Times.

A questão do limite final

A conclusão é que a IA militar não é mais uma escolha; é uma realidade estrutural. A transição da tecnologia experimental para a aquisição central aconteceu nos últimos anos. Isso mudou o foco de “se devemos usar IA” para “como podemos controlá-la”. A lacuna entre o que o público pensa que está acontecendo e o que realmente está acontecendo é grande. As pessoas esperam robôs de ficção científica, mas a realidade é uma transformação silenciosa e orientada por dados de cada sensor e rádio. O risco mais significativo não é uma IA rebelde, mas uma escalada rápida que nenhum humano pode parar. À medida que integramos esses sistemas mais profundamente em nossas estruturas de comando, devemos fazer uma pergunta final: onde está a linha que nunca deixaremos uma máquina cruzar? Até 2026, essa linha permanece indefinida.

Nota do editor: Criamos este site como um centro de notícias e guias de IA multilíngue para pessoas que não são geeks de computador, mas que ainda querem entender a inteligência artificial, usá-la com mais confiança e acompanhar o futuro que já está chegando.

Encontrou um erro ou algo que precisa ser corrigido? Informe-nos.