Най-важните въпроси за военния AI в момента

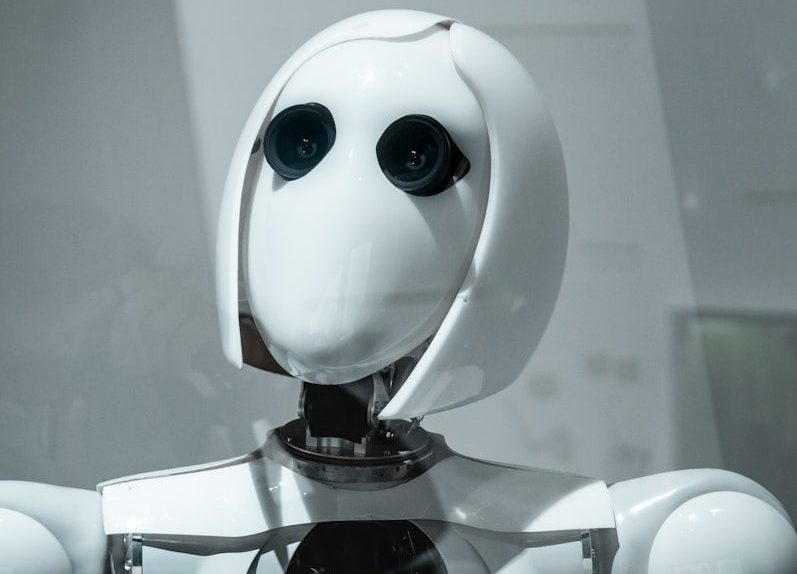

Ерата на дебатите дали AI има място на бойното поле приключи. Правителствата вече подписват договори. Процесът на обществени поръчки се измести от експериментални лаборатории към стандартни договори за отбрана. Тази промяна превръща AI от футуристична концепция в перо от националните бюджети. Фокусът вече не е върху роботи с чувство за самосъхранение, а върху обработката на данни в мащаб. Военните лидери искат системи, които идентифицират цели по-бързо от всеки човек. Те търсят софтуер, който предвижда логистични провали, преди те да се случат. Този преход създава нова реалност за глобалната сигурност. Той принуждава към преосмисляне на това как започват и как завършват войните. Скоростта на вземане на решения се ускорява отвъд човешкото познание. Тук не става въпрос за научна фантастика. Става въпрос за незабавната интеграция на machine learning в сензорите и оръжейните системи, които вече съществуват. Залозите включват повече от просто хардуер. Те включват фундаменталната логика на международната стабилност. Решенията, взети през следващите няколко години, ще определят безопасността на света за десетилетия напред. Реториката за етика се сблъсква с реалността на конкуренцията.

Преходът от лабораторията към бюджета

Военният AI е по същество приложение на machine learning към традиционните функции на отбраната. Това не е едно изобретение, а съвкупност от възможности. Те включват computer vision за drone feeds, natural language processing за прихванати сигнали и автономна навигация за наземни превозни средства. В миналото това бяха изследователски проекти. Днес те са изисквания в заявките за оферти. Целта е sensor fusion. Това означава събиране на данни от сателити, радари и войници на терен и обединяването им в една картина. Когато една система може да обработи милиони точки от данни за секунда, тя идентифицира модели, които човешкият анализатор може да пропусне. Това често се нарича алгоритмична война. Тя разчита на способността за обучение на модели върху масивни масиви от данни за исторически битки и информация за терена. Преходът към софтуерно дефинирана отбрана означава, че един танк или изтребител е толкова добър, колкото е кодът, работещ вътре в него. Това променя начина, по който компаниите изграждат хардуер. Сега те трябва да дават приоритет на compute power и data throughput пред традиционната броня или скорост. Съвременните поръчки се фокусират върху това колко лесно една система може да получи over the air update. Ако един модел остарее, хардуерът се превръща в пасив. Ето защо министерствата на отбраната ухажват Силициевата долина. Те се нуждаят от гъвкавостта на търговската разработка на софтуер, за да останат пред противниците. Разликата между прототип и внедрена система се стеснява. Виждаме възхода на софтуерно-ориентираната армия. Това движение не е само за оръжия. Става въпрос за целия бекенд на военната машина, от заплатите до управлението на частите. Всеки аспект на организацията се превръща в проблем с данни.

Глобално триене и новата надпревара във въоръжаването

Глобалното въздействие на този преход е неравномерно. Докато САЩ и Китай водят в инвестициите, други нации са принудени да избират между разработването на собствени системи или купуването им от лидерите. Това създава нови зависимости. Нация, която купува флот от AI-управлявани дронове, купува и data pipeline и моделите за обучение на доставчика. Това е нова форма на soft power. Това е и източник на нестабилност. Когато две AI-управлявани сили се изправят една срещу друга, рискът от случайна ескалация се увеличава. Машините реагират със скорости, които не позволяват човешка дипломация. Ако една система интерпретира тренировъчно учение като атака, контраотговорът се случва за милисекунди. Това компресира времето, достъпно за лидерите, за да разговарят и да деескалират. Разликата между реторика и внедряване също е основен фактор. Лидерите често говорят за смислен човешки контрол публично. Въпреки това, логиката на поръчките изисква повече автономност, за да останат конкурентоспособни. Не можете да имате човек в цикъла, ако вражеската система е десет пъти по-бърза. Това създава надпревара към дъното по отношение на стандартите за безопасност. Следните области са най-засегнати от тази глобална промяна:

- Национален суверенитет върху данни и алгоритми за отбрана.

- Стабилността на ядреното възпиране в ерата на бързото вземане на решения.

- Икономическата пропаст между технологично напредналите армии и традиционните.

- Правните рамки, регулиращи международните конфликти и военните престъпления.

- Ролята на частните корпорации в решенията за национална сигурност.

Малките нации са особено уязвими. Те могат да се окажат тестови площадки за нови технологии. Скоростта на иновациите изпреварва способността на международните органи да пишат правила. Това оставя вакуум, в който най-силната технология печели независимо от правната цена. Това е отразено в последните доклади за отбраната, които подчертават бързото приемане на автономни системи в зони на активен конфликт.

Вторник в офиса по обществени поръчки

Представете си служител по обществени поръчки на име Сара, работеща в модерно министерство на отбраната в 2026. Нейният ден не включва разглеждане на чертежи за нови пушки. Вместо това тя прекарва сутринта си в преглед на споразумения за cloud услуги и API документация. Тя трябва да реши кой модел за computer vision да купи за нов флот от дронове за наблюдение. Един доставчик обещава 99-процентна точност, но изисква постоянна връзка с централен сървър. Друг предлага 85-процентна точност, но работи изцяло на самия дрон. Сара знае, че в реален конфликт връзката със сървъра ще бъде заглушена. Тя трябва да претегли цената на точността спрямо реалността на бойното поле. До обяд тя е на среща относно правата върху данните. Компанията, предоставяща AI, иска да запази данните, които дроновете събират, за да обучава бъдещите си модели. Сара знае, че това е риск за сигурността. Ако компанията бъде хакната, врагът ще знае точно какво са видели дроновете. Това е новото лице на военното планиране. Това е постоянен компромис между производителност и сигурност. Натискът за ускоряване на цикъла на придобиване е огромен. Нейните началници искат най-новата технология сега, а не след пет години. Те виждат какво се случва в текущите конфликти, където евтини дронове и интелигентен софтуер превъзхождат скъпите legacy системи. Следобед Сара преглежда доклад за model drift. AI, който трябваше да идентифицира превозни средства, започва да се проваля, защото средата се е променила. Сезоните са се сменили и сенките са различни. Машината е объркана от калта. Сара трябва да намери начин да актуализира моделите на терен, без да излага мрежата на риск. Това не е видеоигра. Това е логистичен кошмар с високи залози. Една грешка в кода може да доведе до инцидент с приятелски огън или пропусната заплаха. В края на деня Сара не е сигурна дали купува оръжие или абонаментна услуга. Границата между изпълнител на отбранителни поръчки и доставчик на софтуер е изчезнала. Тази промяна се усеща от всички, от фабриката до фронтовата линия. Войниците сега трябва да се доверяват на кутия с вериги, за да им каже кой е приятел и кой е враг. Психологическото въздействие на тази промяна тепърва започва да се разбира.

BotNews.today използва инструменти за изкуствен интелект за проучване, писане, редактиране и превод на съдържание. Нашият екип преглежда и наблюдава процеса, за да запази информацията полезна, ясна и надеждна.

Скритите разходи на алгоритмичното доверие

Трябва да зададем трудни въпроси относно скритите разходи на този преход. Какво се случва с отчетността, когато една машина направи грешка? Ако автономна система удари цивилна цел, кой носи отговорност? Програмистът, служителят по поръчките или командирът, който я е включил? Настоящите правни рамки не са подготвени за това. Съществува и въпросът за поверителността. Военният AI за наблюдение не спира на границата. Същата технология, използвана за проследяване на бунтовници, може да се използва за наблюдение на местното население. Природата на AI с двойна употреба означава, че всеки военен напредък е потенциален инструмент за държавно наблюдение. Трябва също да вземем предвид цената на данните. Обучението на тези модели изисква огромни количества енергия и вода за центровете за данни. Тези екологични разходи рядко са включени в бюджета за отбрана. Съществува и рискът от вземане на решения тип „черна кутия“. Ако един генерал не може да обясни защо AI е препоръчал конкретен удар, можем ли да се доверим на препоръката? Липсата на прозрачност в моделите за deep learning е фундаментален недостатък във военен контекст. Ние изграждаме системи, които не разбираме напълно. Това създава крехка среда за сигурност. Ако противник намери начин да отрови данните за обучение, той може да победи системата, без да произведе нито един изстрел. Това е нов вид уязвимост. Как да проверим дали един модел не е бил подправен? Как да гарантираме, че AI остава в съответствие с човешките ценности по време на хаоса на войната? Това не са само технически проблеми. Те са морални и екзистенциални. Бързането за внедряване на AI може да създава повече проблеми, отколкото решава. Ние заменяме човешката преценка със скоростта на машината, но може да губим контрол върху последствията. Организации като Brookings Institution продължават да бият тревога по тези точно въпроси.

Под капака на тактическото извеждане

Техническата реалност на военния AI се намира в „гийк“ секцията на бюджета. Става въпрос за inference at the edge. Това означава изпълнение на сложни модели върху малък, подсилен хардуер без cloud връзка. Инженерите са фокусирани върху оптимизирането на моделите, за да се поберат в ограничената памет на дрон или ръчно устройство. Те използват техники като квантуване и подрязване, за да намалят размера на невронните мрежи. API лимитите са основна грижа за системите, които трябва да комуникират между различните клонове на армията. Ако AI на флота не може да говори с AI на военновъздушните сили поради проприетарен интерфейс, системата се проваля. Това доведе до натиск за отворени стандарти във военния софтуер. Локалното съхранение е друга пречка. Един полет за наблюдение може да генерира терабайти данни. Обработката на тези данни локално е от съществено значение, тъй като честотната лента е ограничена в зона на бойни действия. Хардуерът трябва да бъде и MIL-SPEC, което означава, че може да оцелее при екстремна топлина, вибрации и електромагнитни импулси. Компаниите сега се състезават да предоставят чиповете и слоевете за интеграция на данни, които правят алгоритмичната война възможна. Работният процес включва няколко специфични стъпки:

- Приемане на данни от хетерогенни сензорни масиви.

- Предварителна обработка на устройството за филтриране на шума.

- Извеждане с помощта на невронни двигатели с ниска латентност.

- Изпълним изход, доставен до интерфейс човек-машина.

- Обратно предаване на данни след мисия за преобучение на модели.

Ограничението често не е алгоритъмът, а животът на батерията и разсейването на топлината на хардуера. С нарастването на моделите, изискванията за мощност растат. Това създава таван за това, което може да бъде внедрено на фронтовата линия. Инженерите сега гледат към специализирани ASIC, за да решат това. Тези чипове са проектирани за една задача, като откриване на обекти, и са много по-ефективни от процесорите с общо предназначение. Тук се случва истинската надпревара. Това е битка за ефективност и термично управление. Можете да прочетете повече за тези хардуерни предизвикателства в технологичната секция на New York Times.

Въпросът за крайния праг

Изводът е, че военният AI вече не е избор. Това е структурна реалност. Преходът от експериментална технология към основна поръчка се случи през последните няколко години. Това измести фокуса от това дали трябва да използваме AI към това как можем да го контролираме. Пропастта между това, което обществеността мисли, че се случва, и това, което всъщност се случва, е голяма. Хората очакват научнофантастични роботи, но реалността е тиха, управлявана от данни трансформация на всеки сензор и радио. Най-значимият риск не е AI, излязъл извън контрол, а бързо развиваща се ескалация, която никой човек не може да спре. Докато интегрираме тези системи по-дълбоко в нашите командни структури, трябва да зададем един последен въпрос. Къде е линията, която никога няма да позволим на машина да премине? Към 2026, тази линия остава недефинирана.

Бележка на редактора: Създадохме този сайт като многоезичен център за новини и ръководства за изкуствен интелект за хора, които не са компютърни маниаци, но все пак искат да разберат изкуствения интелект, да го използват с повече увереност и да следят бъдещето, което вече настъпва.

Открихте грешка или нещо, което трябва да бъде коригирано? Уведомете ни.