De 10 AI-tendenser, der kan definere 2026

Hvedebrødsdagene for generative værktøjer er ved at være forbi. Inden 2026 vil fokus skifte fra nyhedsværdien i chat-interfaces til den underliggende infrastruktur, der driver dem. Vi bevæger os ind i en æra, hvor det primære spørgsmål ikke er, hvad softwaren kan sige, men hvordan den drives, hvem der ejer dens “weights”, og hvor dataene befinder sig. Industrien er på vej mod et strukturelt skifte i, hvordan information behandles og distribueres globalt. Det handler ikke længere om eksperimenterende bots. Det handler om integrationen af maskinintelligens i selve internettets VVS og det fysiske elnet. Investorer og brugere begynder at se forbi den indledende begejstring for at få øje på de stigende driftsomkostninger og begrænsningerne i den nuværende hardware. De historier, der vil dominere de kommende måneder, er dem, der adresserer disse fundamentale begrænsninger. Vi ser en bevægelse væk fra centraliseret cloud-dominans mod et mere fragmenteret og specialiseret miljø. Vinderne bliver dem, der kan håndtere de massive energikrav og det stadig mere komplekse juridiske miljø omkring træningsdata.

Det strukturelle skifte i maskinintelligens

Den første store tendens involverer koncentrationen af modelkraft. En lille gruppe virksomheder kontrollerer i øjeblikket de mest avancerede frontier-modeller. Dette skaber en flaskehals for innovation, da mindre aktører må bygge oven på disse proprietære systemer. Vi ser dog et pres for open weight-modeller, der giver organisationer mulighed for at køre højtydende systemer på deres egen hardware. Denne spænding mellem lukkede og åbne systemer vil nå et bristepunkt, når virksomheder skal beslutte, om de vil betale høje abonnementsgebyrer eller investere i deres egen infrastruktur. Samtidig diversificeres hardwaremarkedet. Mens ét firma har domineret chipmarkedet i årevis, begynder konkurrenter og interne silicon-projekter fra store cloud-udbydere at tilbyde alternativer. Dette skifte i forsyningskæden er afgørende for at reducere omkostningerne ved inference og gøre implementering i stor skala bæredygtig for den gennemsnitlige virksomhed.

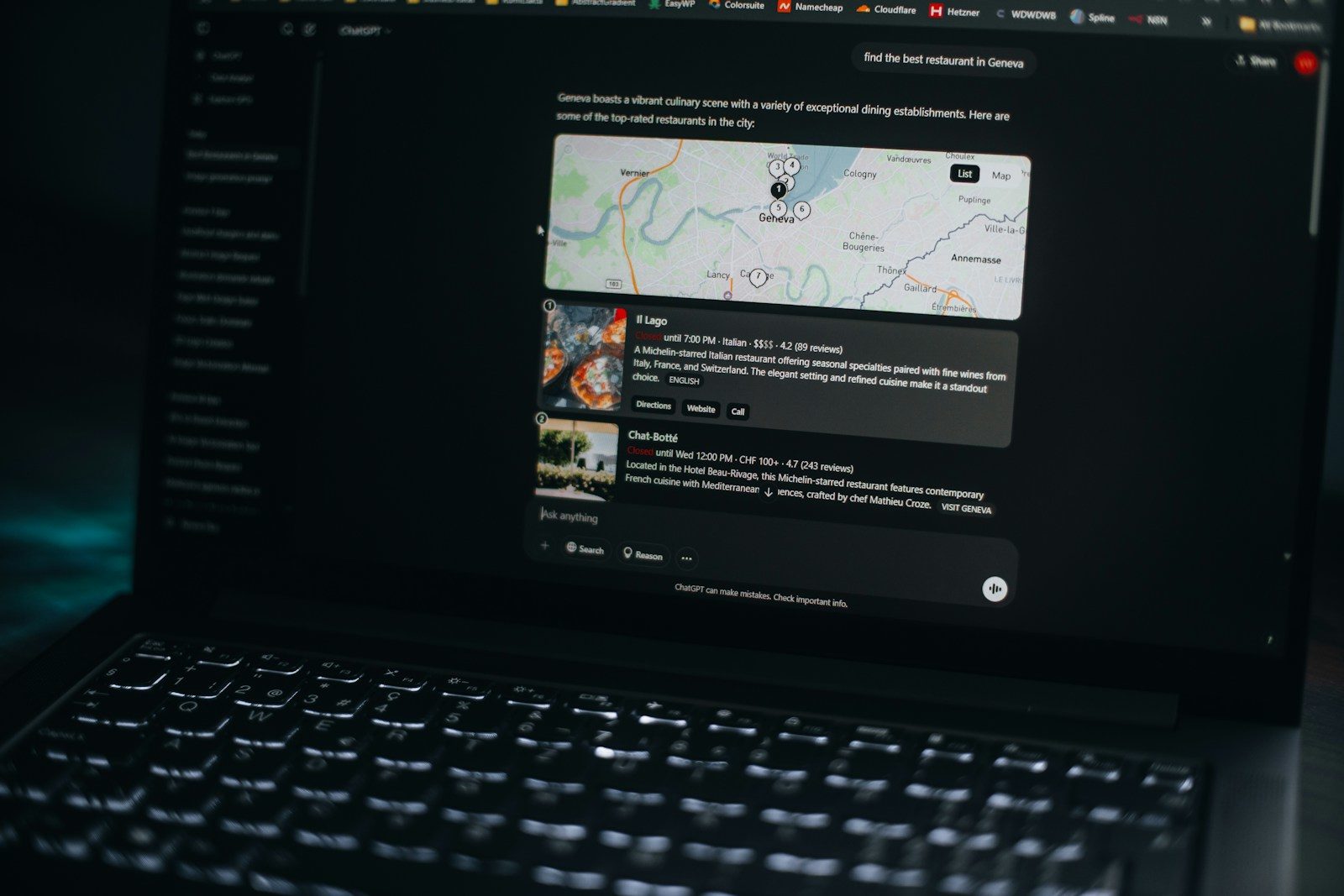

En anden kritisk udvikling er disruptionen af søgning. I årtier var søgefeltet indgangen til internettet. Nu erstatter direkte svar-motorer den traditionelle liste af links. Dette ændrer økonomien på nettet. Hvis en bruger får et komplet svar fra en AI, har de ingen grund til at klikke videre til en kildeside. Dette skaber en krise for udgivere og indholdsskabere, der er afhængige af trafik for at generere omsætning. Vi ser også en stigning i lokal AI-eksekvering. I stedet for at sende hver forespørgsel til en fjern server, tillader nye processorer i laptops og smartphones privat, hurtig og offline behandling. Denne bevægelse mod “the edge” er drevet af både et behov for lavere latency og en voksende efterspørgsel på databeskyttelse. Organisationer indser, at det er en betydelig risiko at sende følsomme virksomhedsdata til en tredjeparts-cloud, som skal mindskes gennem lokale hardwareløsninger.

Den globale påvirkning af automatiserede systemer

Indflydelsen fra disse teknologier rækker langt ud over tech-sektoren. Regeringer betragter nu AI-kapabiliteter som et spørgsmål om national sikkerhed. Dette har ført til et kapløb om silicon-suverænitet, hvor nationer investerer milliarder for at sikre indenlandsk chipproduktion. Vi ser strenge eksportkontroller og handelsblokader designet til at forhindre rivaler i at få adgang til den mest avancerede hardware. Denne geopolitiske spænding afspejles i det regulatoriske rum. EU og forskellige amerikanske agenturer udarbejder regler for, hvordan modeller trænes og implementeres. Disse reguleringer fokuserer på gennemsigtighed, bias og potentialet for misbrug i kritiske sektorer som finans og sundhedsvæsen. Målet er at skabe en ramme, der tillader vækst, mens man forhindrer de farligste udfald af automatiseret beslutningstagning.

Energipres er industriens tavse krise. Efterspørgslen på elektricitet fra datacentre forventes at vokse i et hidtil uset tempo. Dette tvinger tech-virksomheder til at blive energileverandører, der investerer i atomkraft og massive solcelleparker for at holde deres servere kørende. I nogle regioner kan elnettet ikke følge med efterspørgslen, hvilket fører til forsinkelser i opførelsen af datacentre. Dette skaber et geografisk skifte i, hvor tech bygges, med en præference for områder med billig og rigelig strøm. Desuden accelererer brugen af automatiserede systemer i militære sammenhænge. Fra autonome droner til strategiske analyseværktøjer ændrer integrationen af maskinintelligens i forsvarssystemer konfliktens natur. Dette rejser presserende etiske spørgsmål om menneskeligt tilsyn i dødelige beslutninger og potentialet for hurtig eskalering i automatiserede krigsscenarier.

Integration i den virkelige verden og dagligdagen

I en typisk dag i 2026 starter en professionel måske morgenen med at gennemgå et resumé af nattens kommunikation, genereret af en lokal model på deres telefon. Dette sker uden at data forlader enheden, hvilket sikrer, at private tidsplaner og klientnavne forbliver sikre. Under et møde kan en specialiseret agent lytte til samtalen og krydstjekke diskussionen med interne virksomhedsdatabaser i realtid. Denne agent transskriberer ikke bare. Den identificerer modstridende oplysninger i projektplaner og foreslår løsninger baseret på tidligere succesfulde workflows. Dette er virkeligheden i det agentiske skifte, hvor software går fra at være en passiv assistent til en aktiv deltager i arbejdsprocessen.

BotNews.today bruger AI-værktøjer til at researche, skrive, redigere og oversætte indhold. Vores team gennemgår og overvåger processen for at holde informationen nyttig, klar og pålidelig.

Påvirkningen på medier og information er lige så dyb. Deepfakes er gået videre fra simple ansigtsbytte til video og lyd i høj kvalitet, der er næsten umulig at skelne fra virkeligheden. Dette har ført til en tillidskrise i digitalt indhold. For at modvirke dette ser vi indførelsen af kryptografiske signaturer for autentiske medier. Hvert foto eller hver video taget på en smartphone kan snart bære et digitalt vandmærke, der beviser dens oprindelse. Denne kamp for autenticitet er en vigtig historie for alle, der beskæftiger sig med journalistik, politik eller underholdning. Forbrugere bliver mere skeptiske over for, hvad de ser online, hvilket fører til en genopblussen af værdien af betroede brands og verificerede kilder. Omkostningerne ved at verificere information stiger, og de, der kan levere sikkerhed i en æra med syntetiske medier, vil have betydelig magt.

Har du en AI-historie, et værktøj, en trend eller et spørgsmål, du synes, vi burde dække? Send os din artikelidé — vi vil meget gerne høre den.Vi må også overveje påvirkningen på arbejdsmarkedet. Mens nogle jobs forsvinder, bliver andre transformeret. Den mest markante bevægelse sker i mellemledelsen, hvor AI kan håndtere planlægning, rapportering og grundlæggende performance-tracking. Dette tvinger os til at genoverveje, hvad menneskeligt lederskab indebærer. Værdien skifter mod følelsesmæssig intelligens, kompleks problemløsning og etisk dømmekraft. Medarbejdere bliver bedt om at overvåge flåder af digitale agenter, hvilket kræver et nyt sæt tekniske og ledelsesmæssige færdigheder. Denne forandring sker hurtigere, end uddannelsessystemerne kan tilpasse sig, hvilket skaber et talentgab, som virksomheder forsøger at udfylde med interne træningsprogrammer. Kløften mellem dem, der effektivt kan bruge disse værktøjer, og dem, der ikke kan, bliver større, hvilket fører til nye former for økonomisk ulighed, som regeringer kun lige er begyndt at adressere.

Sokratisk skepsis og de skjulte omkostninger

Vi må spørge, hvad den sande omkostning ved denne hurtige adoption er. Hvis vi er afhængige af tre eller fire store virksomheder for vores kognitive infrastruktur, hvad sker der så, når deres interesser afviger fra det fælles bedste? Centraliseringen af intelligens er en risiko, som få diskuterer i dybden. Vi bytter lokal kontrol ud med cloud-baseret bekvemmelighed, men prisen for den bekvemmelighed er et totalt tab af privatliv og en afhængighed af abonnementsmodeller, der kan ændre sig når som helst. Der er også spørgsmålet om selve dataene. De fleste modeller er trænet på det kollektive output af menneskelig kultur. Er det etisk for et selskab at indfange den værdi og sælge den tilbage til os uden kompensation til de oprindelige skabere? De nuværende juridiske kampe om ophavsret er kun begyndelsen på en meget større samtale om ejerskab af information.

Der er en tendens til at overestimere de kortsigtede muligheder i disse systemer, mens man undervurderer deres langsigtede strukturelle påvirkning. Folk forventer en generel intelligens, der kan løse ethvert problem, men hvad vi får, er en række yderst effektive, snævre værktøjer, der er integreret i vores eksisterende software. Faren er ikke en løbsk maskine, men en dårligt forstået algoritme, der træffer beslutninger om kreditvurderinger, jobansøgninger eller medicinske behandlinger. Vi bygger en verden, hvor maskinens logik ofte er uigennemskuelig for de mennesker, der bruger den. Hvordan holder vi et system ansvarligt, hvis vi ikke kan forklare, hvorfor det nåede en bestemt konklusion? Det er ikke bare tekniske problemer. Det er fundamentale spørgsmål om, hvordan vi ønsker, at vores samfund skal fungere. Vi må beslutte, om effektivitetsgevinsterne er tabet af gennemsigtighed og menneskelig handlekraft værd.

Power User-sektionen

For dem, der bygger og administrerer disse systemer, er fokus skiftet til workflow-integration og lokal optimering. Æraen med blot at kalde et massivt API bliver erstattet af sofistikerede orkestreringslag. Power users kigger nu på følgende tekniske begrænsninger:

- API rate limits og omkostningerne ved token-vinduer for modeller med lang kontekst.

- Brug af kvantisering til at køre store modeller på hardware til forbrugere uden væsentligt tab af præcision.

- Implementering af Retrieval Augmented Generation for at sikre, at modeller har adgang til de nyeste interne data.

- Håndtering af lokale vektordatabaser for hurtig og privat informationssøgning.

Workflow-automatisering handler ikke længere om simple triggere. Det involverer at kæde flere modeller sammen, hvor en lille, hurtig model håndterer den indledende routing, og en større, mere kapabel model håndterer den komplekse ræsonnering. Denne lagdelte tilgang er nødvendig for at styre omkostninger og latency. Vi ser også en bevægelse mod specialiseret hardware som NPU’er (Neural Processing Units), der bliver standard i alle nye computerenheder. Dette muliggør vedvarende, strømbesparende AI-funktioner, der kører i baggrunden af operativsystemet. For udviklere er udfordringen ikke længere bare at skrive kode, men at styre livscyklussen for de data, der bruges til at finjustere disse systemer. De 20 procent af brugerne, der forstår denne underliggende mekanik, vil være dem, der definerer den næste generation af softwarearkitektur.

- NVMe-lagringshastigheder er ved at blive en flaskehals for indlæsning af store model-weights i hukommelsen.

- Hukommelsesbåndbredde er vigtigere end rå regnekraft for mange inference-opgaver.

- Fremkomsten af små sprogmodeller (SLM’er), der præsterer lige så godt som ældre store modeller på specifikke opgaver.

Redaktionel note: Vi har oprettet dette websted som et flersproget AI-nyheds- og guidecenter for folk, der ikke er computer-nørder, men stadig ønsker at forstå kunstig intelligens, bruge den med mere selvtillid og følge den fremtid, der allerede er her.

Bundlinjen

De næste to år vil blive defineret af en bevægelse mod pragmatisme. Industrien bevæger sig væk fra “move fast and break things”-mentaliteten mod en mere disciplineret tilgang til at bygge pålidelige, skalerbare og etiske systemer. Vi ser fremkomsten af en ny stack, hvor lokal hardware, specialiserede modeller og streng regulatorisk overholdelse er normen. De historier, der betyder noget, handler ikke om den nyeste chatbot-demo, men om det hårde arbejde med at integrere disse værktøjer i vores verdens fysiske og juridiske strukturer. Succes vil ikke blive målt på modellens kompleksitet, men på den nytte og sikkerhed, den giver slutbrugeren. Overgangen fra hype til nytteværdi er i fuld gang, og resultaterne vil være mere subtile og gennemgribende, end mange forventer.

Har du fundet en fejl eller noget, der skal rettes? Giv os besked.