Las 10 historias de IA que definirán el 2026

La luna de miel con las herramientas generativas está llegando a su fin. Para el 2026, el enfoque pasará de la novedad de las interfaces de chat a la infraestructura subyacente que las sostiene. Entramos en una era donde la preocupación principal no es lo que el software puede decir, sino cómo se alimenta, quién posee los pesos y dónde residen los datos. La industria avanza hacia un cambio estructural en la forma en que la información se procesa y distribuye globalmente. Ya no se trata de bots experimentales, sino de la integración de la inteligencia artificial en la fontanería básica de internet y en la red eléctrica física. Inversores y usuarios comienzan a mirar más allá de la emoción inicial para ver los crecientes costes operativos y los límites del hardware actual. Las historias que dominarán los próximos meses son aquellas que abordan estas restricciones fundamentales. Estamos viendo un alejamiento del dominio centralizado de la cloud hacia un entorno más fragmentado y especializado. Los ganadores serán quienes logren gestionar las enormes necesidades energéticas y el entorno legal cada vez más complejo que rodea a los datos de entrenamiento.

El cambio estructural en la inteligencia artificial

La primera gran historia involucra la concentración del poder de los modelos. Un pequeño grupo de empresas controla actualmente los modelos de frontera más avanzados. Esto crea un cuello de botella para la innovación, ya que los actores más pequeños deben construir sobre estos sistemas propietarios. Sin embargo, vemos un impulso hacia modelos de pesos abiertos que permiten a las organizaciones ejecutar sistemas de alto rendimiento en su propio hardware. Esta tensión entre sistemas cerrados y abiertos llegará a un punto de ruptura a medida que las empresas decidan si pagar altas cuotas de suscripción o invertir en su propia infraestructura. Al mismo tiempo, el mercado de hardware se diversifica. Aunque una empresa ha dominado el mercado de chips durante años, los competidores y los proyectos internos de silicio de los grandes proveedores de cloud están empezando a ofrecer alternativas. Este cambio en la cadena de suministro es esencial para reducir el coste de la inferencia y hacer que el despliegue a gran escala sea sostenible para la empresa promedio.

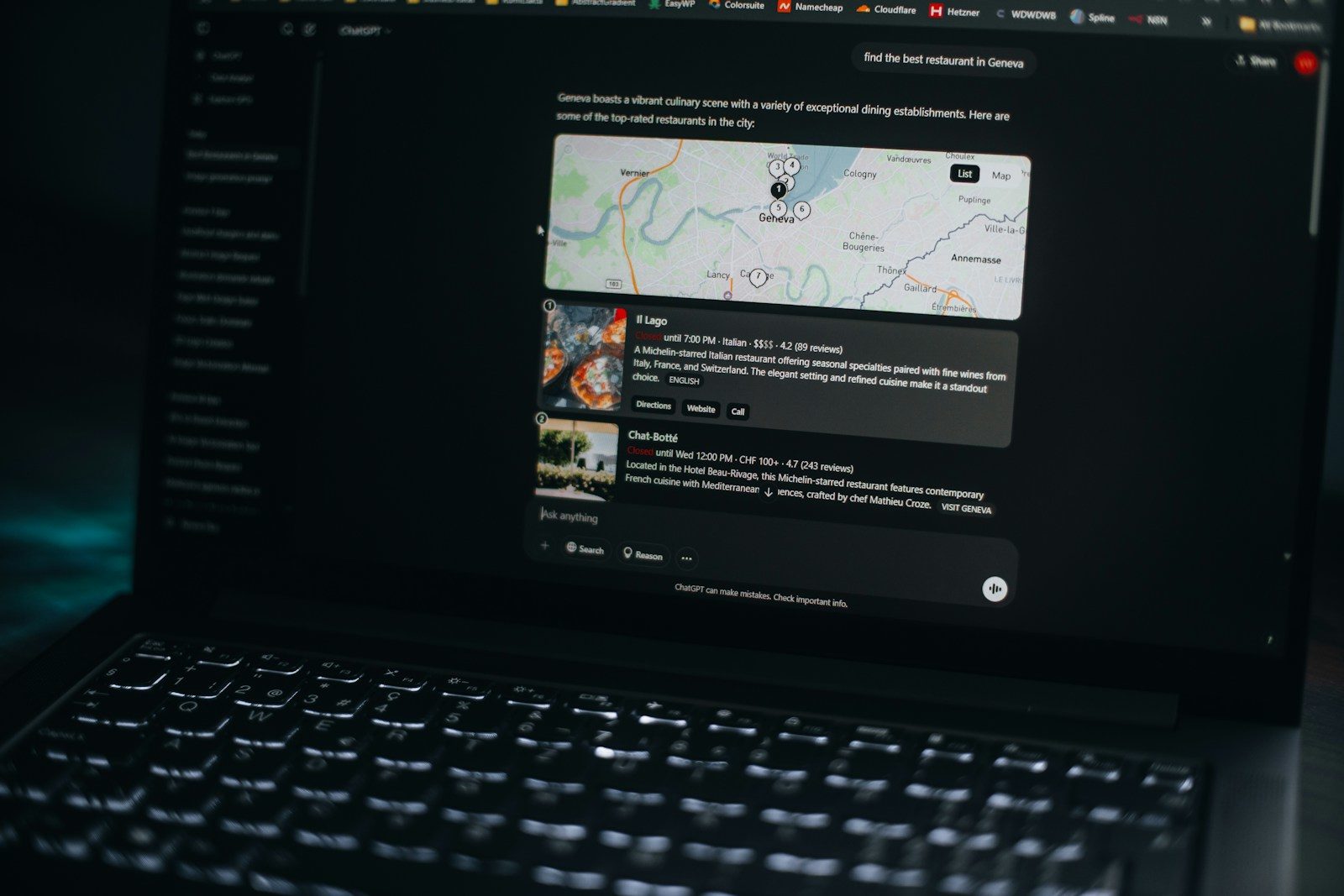

Otro desarrollo crítico es la disrupción de la búsqueda. Durante décadas, la barra de búsqueda fue el punto de entrada a internet. Ahora, los motores de respuesta directa están reemplazando la lista tradicional de enlaces. Esto cambia la economía de la web. Si un usuario obtiene una respuesta completa de una IA, no tiene motivos para hacer clic en un sitio web de origen. Esto crea una crisis para editores y creadores de contenido que dependen del tráfico para generar ingresos. También vemos un auge en la ejecución local de IA. En lugar de enviar cada consulta a un servidor remoto, los nuevos procesadores en portátiles y teléfonos permiten un procesamiento privado, rápido y offline. Este movimiento hacia el edge está impulsado tanto por la necesidad de menor latencia como por la creciente demanda de privacidad de datos. Las organizaciones se dan cuenta de que enviar datos corporativos sensibles a una cloud de terceros es un riesgo significativo que debe mitigarse mediante soluciones de hardware local.

El impacto global de los sistemas automatizados

La influencia de estas tecnologías se extiende mucho más allá del sector tecnológico. Los gobiernos tratan ahora las capacidades de IA como un asunto de seguridad nacional. Esto ha llevado a una carrera por la soberanía del silicio, donde las naciones invierten miles de millones para asegurar su propia producción nacional de chips. Vemos estrictos controles de exportación y bloques comerciales diseñados para evitar que los rivales accedan al hardware más avanzado. Esta tensión geopolítica se refleja en el espacio regulatorio. La Unión Europea y diversas agencias de Estados Unidos están redactando normas para gobernar cómo se entrenan y despliegan los modelos. Estas regulaciones se centran en la transparencia, el sesgo y el potencial de uso indebido en sectores críticos como las finanzas y la salud. El objetivo es crear un marco que permita el crecimiento mientras se previenen los resultados más peligrosos de la toma de decisiones automatizada.

La presión energética es la crisis silenciosa de la industria. Se proyecta que la demanda de electricidad de los centros de datos crecerá a un ritmo sin precedentes. Esto obliga a las empresas tecnológicas a convertirse en proveedores de energía, invirtiendo en energía nuclear y enormes parques solares para mantener sus servidores funcionando. En algunas regiones, la red no puede seguir el ritmo de la demanda, lo que provoca retrasos en la construcción de centros de datos. Esto crea un cambio geográfico en dónde se construye tecnología, favoreciendo áreas con energía barata y abundante. Además, el uso de sistemas automatizados en contextos militares se acelera. Desde drones autónomos hasta herramientas de análisis estratégico, la integración de la inteligencia artificial en los sistemas de defensa está cambiando la naturaleza del conflicto. Esto plantea urgentes cuestiones éticas sobre el papel de la supervisión humana en decisiones letales y el potencial de una rápida escalada en escenarios de guerra automatizada.

Integración en el mundo real y la vida diaria

En un día típico del 2026, un profesional podría comenzar su mañana revisando un resumen de las comunicaciones nocturnas generado por un modelo local en su teléfono. Esto ocurre sin que ningún dato salga del dispositivo, asegurando que los horarios privados y los nombres de los clientes permanezcan seguros. Durante una reunión, un agente especializado podría escuchar la conversación y contrastar la discusión con las bases de datos internas de la empresa en tiempo real. Este agente no solo transcribe. Identifica contradicciones en los cronogramas de proyectos y sugiere soluciones basadas en flujos de trabajo exitosos anteriores. Esta es la realidad del cambio agentico, donde el software pasa de ser un asistente pasivo a un participante activo en el proceso de trabajo.

BotNews.today utiliza herramientas de IA para investigar, escribir, editar y traducir contenido. Nuestro equipo revisa y supervisa el proceso para mantener la información útil, clara y fiable.

El impacto en los medios y la información es igualmente profundo. Los deepfakes han ido más allá de simples intercambios de rostros hacia video y audio de alta fidelidad que es casi imposible de distinguir de la realidad. Esto ha llevado a una crisis de confianza en el contenido digital. Para contrarrestarlo, vemos la adopción de firmas criptográficas para medios auténticos. Cada foto o video tomado en un smartphone pronto podría llevar una marca de agua digital que pruebe su origen. Esta batalla por la autenticidad es una historia importante para cualquiera involucrado en periodismo, política o entretenimiento. Los consumidores se vuelven más escépticos de lo que ven online, lo que lleva a un resurgimiento del valor de las marcas de confianza y fuentes verificadas. El coste de verificar la información aumenta, y quienes puedan proporcionar certeza en una era de medios sintéticos tendrán un poder significativo.

¿Tienes una historia, herramienta, tendencia o pregunta sobre IA que crees que deberíamos cubrir? Envíanos tu idea de artículo — nos encantaría escucharla.También debemos considerar el impacto en el mercado laboral. Mientras algunos empleos son desplazados, otros se transforman. El movimiento más significativo ocurre en la capa de gestión media, donde la IA puede manejar la programación, los informes y el seguimiento básico del rendimiento. Esto obliga a una reevaluación de cómo se ve el liderazgo humano. El valor se desplaza hacia la inteligencia emocional, la resolución de problemas complejos y el juicio ético. Se pide a los trabajadores que supervisen flotas de agentes digitales, lo que requiere un nuevo conjunto de habilidades técnicas y de gestión. Este cambio ocurre más rápido de lo que los sistemas educativos pueden adaptarse, creando una brecha de talento que las empresas intentan llenar con programas de formación interna. La división entre quienes pueden usar estas herramientas eficazmente y quienes no se está ampliando, lo que lleva a nuevas formas de desigualdad económica que los gobiernos apenas comienzan a abordar.

Escepticismo socrático y los costes ocultos

Debemos preguntarnos cuál es el verdadero coste de esta rápida adopción. Si dependemos de tres o cuatro grandes empresas para nuestra infraestructura cognitiva, ¿qué sucede cuando sus intereses divergen del bien público? La centralización de la inteligencia es un riesgo que pocos discuten a fondo. Estamos cambiando el control local por la conveniencia basada en la cloud, pero el precio de esa conveniencia es una pérdida total de privacidad y una dependencia de modelos de suscripción que pueden cambiar en cualquier momento. También existe la cuestión de los datos en sí. La mayoría de los modelos se entrenan con el resultado colectivo de la cultura humana. ¿Es ético que una corporación capture ese valor y nos lo venda de vuelta sin compensación para los creadores originales? Las batallas legales actuales sobre los derechos de autor son solo el comienzo de una conversación mucho más amplia sobre la propiedad de la información.

Existe una tendencia a sobreestimar las capacidades a corto plazo de estos sistemas mientras se subestima su impacto estructural a largo plazo. La gente espera una inteligencia general que pueda resolver cualquier problema, pero lo que obtenemos es una serie de herramientas altamente eficientes y estrechas que se integran en nuestro software existente. El peligro no es una máquina rebelde, sino un algoritmo mal comprendido que toma decisiones sobre puntajes de crédito, solicitudes de empleo o tratamientos médicos. Estamos construyendo un mundo donde la lógica de la máquina es a menudo opaca para los humanos que la usan. ¿Cómo hacemos responsable a un sistema si no podemos explicar por qué llegó a una conclusión específica? Estos no son solo problemas técnicos. Son preguntas fundamentales sobre cómo queremos que funcione nuestra sociedad. Debemos decidir si las ganancias en eficiencia valen la pérdida de transparencia y agencia humana.

La sección para usuarios avanzados

Para quienes construyen y gestionan estos sistemas, el enfoque se ha desplazado hacia la integración del flujo de trabajo y la optimización local. La era de simplemente llamar a una API masiva está siendo reemplazada por sofisticadas capas de orquestación. Los usuarios avanzados ahora observan las siguientes restricciones técnicas:

- Límites de tasa de API y el coste de las ventanas de tokens para modelos de contexto largo.

- El uso de cuantización para ejecutar grandes modelos en hardware de consumo sin una pérdida significativa en la precisión.

- La implementación de Retrieval Augmented Generation para asegurar que los modelos tengan acceso a los datos internos más recientes.

- La gestión de bases de datos vectoriales locales para una recuperación de información rápida y privada.

La automatización del flujo de trabajo ya no trata sobre disparadores simples. Implica encadenar múltiples modelos, donde un modelo pequeño y rápido maneja el enrutamiento inicial y un modelo más grande y capaz maneja el razonamiento complejo. Este enfoque escalonado es necesario para gestionar costes y latencia. También vemos un movimiento hacia hardware especializado como las NPU (Neural Processing Units) convirtiéndose en estándar en todos los nuevos dispositivos informáticos. Esto permite funciones de IA persistentes y de bajo consumo que se ejecutan en segundo plano del sistema operativo. Para los desarrolladores, el desafío ya no es solo escribir código, sino gestionar el ciclo de vida de los datos utilizados para ajustar estos sistemas. El 20 por ciento de los usuarios que entiendan estos mecanismos subyacentes serán quienes definan la próxima generación de arquitectura de software.

- Las velocidades de almacenamiento NVMe se están convirtiendo en un cuello de botella para cargar pesos de modelos grandes en la memoria.

- El ancho de banda de la memoria es más importante que la potencia de cómputo bruta para muchas tareas de inferencia.

- El auge de los modelos de lenguaje pequeños (SLM) que funcionan tan bien como los modelos grandes antiguos en tareas específicas.

Nota del editor: Creamos este sitio como un centro multilingüe de noticias y guías sobre IA para personas que no son expertos en informática, pero que aún quieren entender la inteligencia artificial, usarla con más confianza y seguir el futuro que ya está llegando.

En resumen

Los próximos dos años se definirán por un movimiento hacia el pragmatismo. La industria se aleja de la mentalidad de