De 10 AI-trendene som kan definere 2026

Honeymoon-perioden for generative verktøy er over. Innen 2026 vil fokuset skifte fra nyhetens interesse ved chat-grensesnitt til den underliggende infrastrukturen som støtter dem. Vi går inn i en æra der hovedbekymringen ikke er hva programvaren kan si, men hvordan den drives, hvem som eier vektene, og hvor dataene lagres. Industrien beveger seg mot et strukturelt skifte i hvordan informasjon prosesseres og distribueres globalt. Dette handler ikke lenger om eksperimentelle boter. Det handler om integrering av maskinintelligens i selve rørleggerarbeidet til internett og det fysiske strømnettet. Investorer og brukere begynner å se forbi den første begeistringen for å se de økende driftskostnadene og begrensningene i dagens hardware. Historiene som vil dominere de kommende månedene er de som adresserer disse fundamentale begrensningene. Vi ser en bevegelse bort fra sentralisert cloud-dominans mot et mer fragmentert og spesialisert miljø. Vinnerne blir de som kan håndtere de massive energikravene og det stadig mer komplekse juridiske miljøet rundt treningsdata.

Det strukturelle skiftet i maskinintelligens

Den første store historien involverer konsentrasjonen av modellkraft. En liten gruppe selskaper kontrollerer for øyeblikket de mest avanserte frontier-modellene. Dette skaper en flaskehals for innovasjon ettersom mindre aktører må bygge på toppen av disse proprietære systemene. Vi ser imidlertid et press for open weight-modeller som lar organisasjoner kjøre høyytelsessystemer på egen hardware. Denne spenningen mellom lukkede og åpne systemer vil nå et bristepunkt når selskaper må bestemme seg for om de skal betale høye abonnementsavgifter eller investere i egen infrastruktur. Samtidig diversifiseres hardware-markedet. Mens ett selskap har dominert chip-markedet i årevis, begynner konkurrenter og interne silisiumprosjekter fra store cloud-leverandører å tilby alternativer. Dette skiftet i forsyningskjeden er essensielt for å redusere kostnadene ved inference og gjøre storskala utrulling bærekraftig for den gjennomsnittlige bedriften.

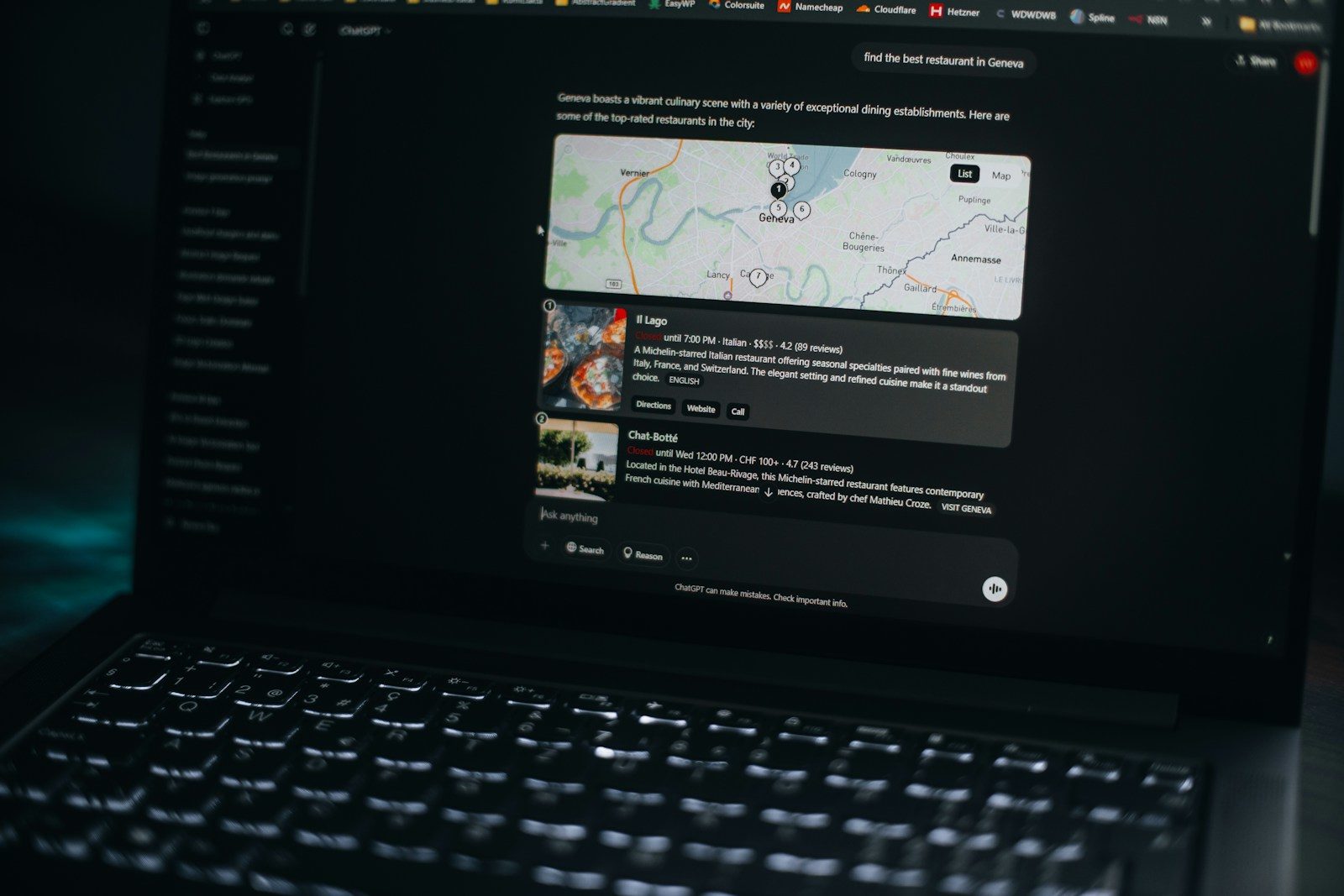

En annen kritisk utvikling er forstyrrelsen av søk. I flere tiår var søkefeltet inngangsporten til internett. Nå erstatter direkte svar-motorer den tradisjonelle listen med lenker. Dette endrer økonomien på nettet. Hvis en bruker får et komplett svar fra en AI, har de ingen grunn til å klikke seg videre til et kildenettsted. Dette skaper en krise for utgivere og innholdsskapere som er avhengige av trafikk for inntekter. Vi ser også en økning i lokal AI-kjøring. I stedet for å sende hvert spørsmål til en ekstern server, tillater nye prosessorer i laptoper og telefoner privat, rask og offline prosessering. Denne bevegelsen mot edge er drevet av både et behov for lavere latency og en økende etterspørsel etter personvern. Organisasjoner innser at det å sende sensitiv bedriftsdata til en tredjeparts cloud er en betydelig risiko som må begrenses gjennom lokale hardware-løsninger.

Den globale effekten av automatiserte systemer

Påvirkningen fra disse teknologiene strekker seg langt utover tech-sektoren. Myndigheter behandler nå AI-kapasiteter som et spørsmål om nasjonal sikkerhet. Dette har ført til et kappløp om silisium-suverenitet, der nasjoner investerer milliarder for å sikre at de har innenlandsk chip-produksjon. Vi ser strenge eksportkontroller og handelsblokker designet for å hindre rivaler i å få tilgang til den mest avanserte hardwaren. Denne geopolitiske spenningen speiles i det regulatoriske rommet. EU og ulike amerikanske etater utarbeider regler for å styre hvordan modeller trenes og rulles ut. Disse reguleringene fokuserer på åpenhet, bias og potensialet for misbruk i kritiske sektorer som finans og helse. Målet er å skape et rammeverk som tillater vekst samtidig som man forhindrer de farligste utfallene av automatisert beslutningstaking.

Energipress er industriens stille krise. Etterspørselen etter strøm fra datasentre er forventet å vokse i et enestående tempo. Dette tvinger tech-selskaper til å bli energileverandører, med investeringer i kjernekraft og massive solparker for å holde serverne i gang. I enkelte regioner kan ikke strømnettet holde tritt med etterspørselen, noe som fører til forsinkelser i bygging av datasentre. Dette skaper et geografisk skifte i hvor tech bygges, og favoriserer områder med billig og rikelig med strøm. Videre akselererer bruken av automatiserte systemer i militære sammenhenger. Fra autonome droner til strategiske analyseverktøy, integreringen av maskinintelligens i forsvarssystemer endrer konfliktens natur. Dette reiser presserende etiske spørsmål om rollen til menneskelig tilsyn i dødelige beslutninger og potensialet for rask eskalering i automatiserte krigføringsscenarier.

Integrering i den virkelige verden og dagliglivet

I en typisk dag innen 2026, kan en profesjonell starte morgenen med å gå gjennom et sammendrag av nattens kommunikasjon generert av en lokal modell på telefonen. Dette skjer uten at data forlater enheten, noe som sikrer at private timeplaner og klientnavn forblir trygge. Under et møte kan en spesialisert agent lytte til samtalen og kryssreferere diskusjonen med interne bedriftsdatabaser i sanntid. Denne agenten bare transkriberer ikke. Den identifiserer motsetninger i prosjektplaner og foreslår løsninger basert på tidligere vellykkede arbeidsflyter. Dette er virkeligheten av det agentiske skiftet, hvor programvare går fra å være en passiv assistent til en aktiv deltaker i arbeidsprosessen.

BotNews.today bruker AI-verktøy for å forske, skrive, redigere og oversette innhold. Teamet vårt gjennomgår og overvåker prosessen for å holde informasjonen nyttig, klar og pålitelig.

Effekten på media og informasjon er like dyp. Deepfakes har beveget seg forbi enkle ansiktsbytter til video og lyd med høy kvalitet som er nesten umulig å skille fra virkeligheten. Dette har ført til en tillitskrise i digitalt innhold. For å motvirke dette ser vi innføringen av kryptografiske signaturer for autentiske medier. Hvert bilde eller video tatt på en smarttelefon kan snart bære et digitalt vannmerke som beviser opprinnelsen. Denne kampen for autentisitet er en stor historie for alle som jobber med journalistikk, politikk eller underholdning. Forbrukere blir mer skeptiske til det de ser på nettet, noe som fører til en gjenoppblomstring av verdien til betrodde merkevarer og verifiserte kilder. Kostnaden ved å verifisere informasjon stiger, og de som kan tilby sikkerhet i en æra med syntetiske medier vil sitte med betydelig makt.

Har du en AI-historie, et verktøy, en trend eller et spørsmål du synes vi bør dekke? Send oss din artikkelidé — vi vil gjerne høre den.Vi må også vurdere effekten på arbeidsmarkedet. Mens noen jobber blir erstattet, blir andre transformert. Den mest betydelige bevegelsen skjer i mellomlederlaget, der AI kan håndtere planlegging, rapportering og grunnleggende ytelsesoppfølging. Dette tvinger frem en re-evaluering av hvordan menneskelig lederskap ser ut. Verdien skifter mot emosjonell intelligens, kompleks problemløsning og etisk dømmekraft. Arbeidere blir bedt om å overvåke flåter av digitale agenter, noe som krever et nytt sett med tekniske og ledelsesmessige ferdigheter. Denne endringen skjer raskere enn utdanningssystemene kan tilpasse seg, noe som skaper et talentgap som selskaper prøver å fylle med interne treningsprogrammer. Skillet mellom de som effektivt kan bruke disse verktøyene og de som ikke kan det, øker, noe som fører til nye former for økonomisk ulikhet som myndighetene bare så vidt har begynt å adressere.

Sokratisk skepsis og de skjulte kostnadene

Vi må spørre hva den sanne kostnaden av denne raske adopsjonen er. Hvis vi stoler på tre eller fire store selskaper for vår kognitive infrastruktur, hva skjer når deres interesser avviker fra det felles beste? Sentraliseringen av intelligens er en risiko få diskuterer i dybden. Vi bytter lokal kontroll mot cloud-basert bekvemmelighet, men prisen for den bekvemmeligheten er et totalt tap av personvern og en avhengighet av abonnementsmodeller som kan endres når som helst. Det er også spørsmålet om selve dataene. De fleste modeller er trent på den kollektive produksjonen av menneskelig kultur. Er det etisk for et selskap å fange den verdien og selge den tilbake til oss uten kompensasjon til de opprinnelige skaperne? De nåværende juridiske kampene om opphavsrett er bare begynnelsen på en mye større samtale om eierskap til informasjon.

Det er en tendens til å overestimere de kortsiktige mulighetene til disse systemene mens man undervurderer deres langsiktige strukturelle effekt. Folk forventer en generell intelligens som kan løse ethvert problem, men det vi får er en serie høyeffektive, smale verktøy som er integrert i vår eksisterende programvare. Faren er ikke en løpsk maskin, men en dårlig forstått algoritme som tar beslutninger om kredittscore, jobbsøknader eller medisinsk behandling. Vi bygger en verden der maskinens logikk ofte er ugjennomsiktig for menneskene som bruker den. Hvordan holder vi et system ansvarlig hvis vi ikke kan forklare hvorfor det kom til en spesifikk konklusjon? Dette er ikke bare tekniske problemer. Det er fundamentale spørsmål om hvordan vi ønsker at samfunnet vårt skal fungere. Vi må bestemme om effektivitetsgevinstene er verdt tapet av åpenhet og menneskelig handlekraft.

Power User-seksjonen

For de som bygger og administrerer disse systemene, har fokuset skiftet til arbeidsflyt-integrering og lokal optimalisering. Æraen med å bare kalle en massiv API blir erstattet av sofistikerte orkestreringslag. Power users ser nå på følgende tekniske begrensninger:

- API-rate limits og kostnaden for token-vinduer for modeller med lang kontekst.

- Bruk av kvantisering for å kjøre store modeller på forbruker-hardware uten betydelig tap i nøyaktighet.

- Implementering av Retrieval Augmented Generation for å sikre at modeller har tilgang til de nyeste interne dataene.

- Håndtering av lokale vektordatabaser for rask og privat informasjonsinnhenting.

Arbeidsflyt-automatisering handler ikke lenger om enkle triggere. Det innebærer å kjede sammen flere modeller, der en liten, rask modell håndterer innledende ruting og en større, mer kapabel modell håndterer den komplekse resonneringen. Denne lagdelte tilnærmingen er nødvendig for å håndtere kostnader og latency. Vi ser også en bevegelse mot spesialisert hardware som NPU-er (Neural Processing Units) som blir standard i alle nye datamaskiner. Dette muliggjør vedvarende, strømgjerrige AI-funksjoner som kjører i bakgrunnen av operativsystemet. For utviklere er utfordringen ikke lenger bare å skrive kode, men å håndtere livssyklusen til dataene som brukes til å finjustere disse systemene. De 20 prosentene av brukerne som forstår denne underliggende mekanikken vil være de som definerer neste generasjon programvarearkitektur.

- NVMe-lagringshastigheter er i ferd med å bli en flaskehals for lasting av store modellvekter i minnet.

- Minnebåndbredde er viktigere enn rå regnekraft for mange inference-oppgaver.

- Fremveksten av små språkmodeller (SLM-er) som presterer like bra som eldre store modeller på spesifikke oppgaver.

Redaktørens merknad: Vi opprettet dette nettstedet som et flerspråklig knutepunkt for AI-nyheter og guider for folk som ikke er datanerder, men som likevel ønsker å forstå kunstig intelligens, bruke den med større selvtillit og følge fremtiden som allerede er her.

Konklusjon

De neste to årene vil bli definert av en bevegelse mot pragmatisme. Industrien beveger seg bort fra