Le 10 tendenze AI che potrebbero definire il 2026

La luna di miele con gli strumenti generativi sta finendo. Entro il , l’attenzione si sposterà dalla novità delle interfacce di chat all’infrastruttura sottostante che le supporta. Stiamo entrando in un’era in cui la preoccupazione principale non è ciò che il software può dire, ma come viene alimentato, chi possiede i pesi e dove risiedono i dati. L’industria si sta muovendo verso un cambiamento strutturale nel modo in cui le informazioni vengono elaborate e distribuite in tutto il mondo. Non si tratta più di bot sperimentali. Si tratta dell’integrazione dell’intelligenza artificiale nelle tubature fondamentali di internet e nella rete elettrica fisica. Investitori e utenti stanno iniziando a guardare oltre l’entusiasmo iniziale per vedere i costi operativi in aumento e i limiti dell’hardware attuale. Le storie che domineranno i prossimi mesi sono quelle che affrontano questi vincoli fondamentali. Stiamo assistendo a un allontanamento dal dominio del cloud centralizzato verso un ambiente più frammentato e specializzato. I vincitori saranno coloro che sapranno gestire gli enormi requisiti energetici e l’ambiente legale sempre più complesso che circonda i dati di addestramento.

Il cambiamento strutturale nell’intelligenza artificiale

La prima grande tendenza riguarda la concentrazione del potere dei modelli. Un piccolo gruppo di aziende controlla attualmente i modelli di frontiera più avanzati. Questo crea un collo di bottiglia per l’innovazione, poiché i player più piccoli devono basarsi su questi sistemi proprietari. Tuttavia, stiamo vedendo una spinta verso modelli open weight che consentono alle organizzazioni di eseguire sistemi ad alte prestazioni sul proprio hardware. Questa tensione tra sistemi chiusi e aperti raggiungerà un punto di rottura quando le aziende decideranno se pagare costosi abbonamenti o investire nella propria infrastruttura. Allo stesso tempo, il mercato dell’hardware si sta diversificando. Mentre un’azienda ha dominato il mercato dei chip per anni, i concorrenti e i progetti di silicio interni dei principali cloud provider stanno iniziando a offrire alternative. Questo spostamento nella supply chain è essenziale per ridurre il costo dell’inferenza e rendere sostenibile la distribuzione su larga scala per l’azienda media.

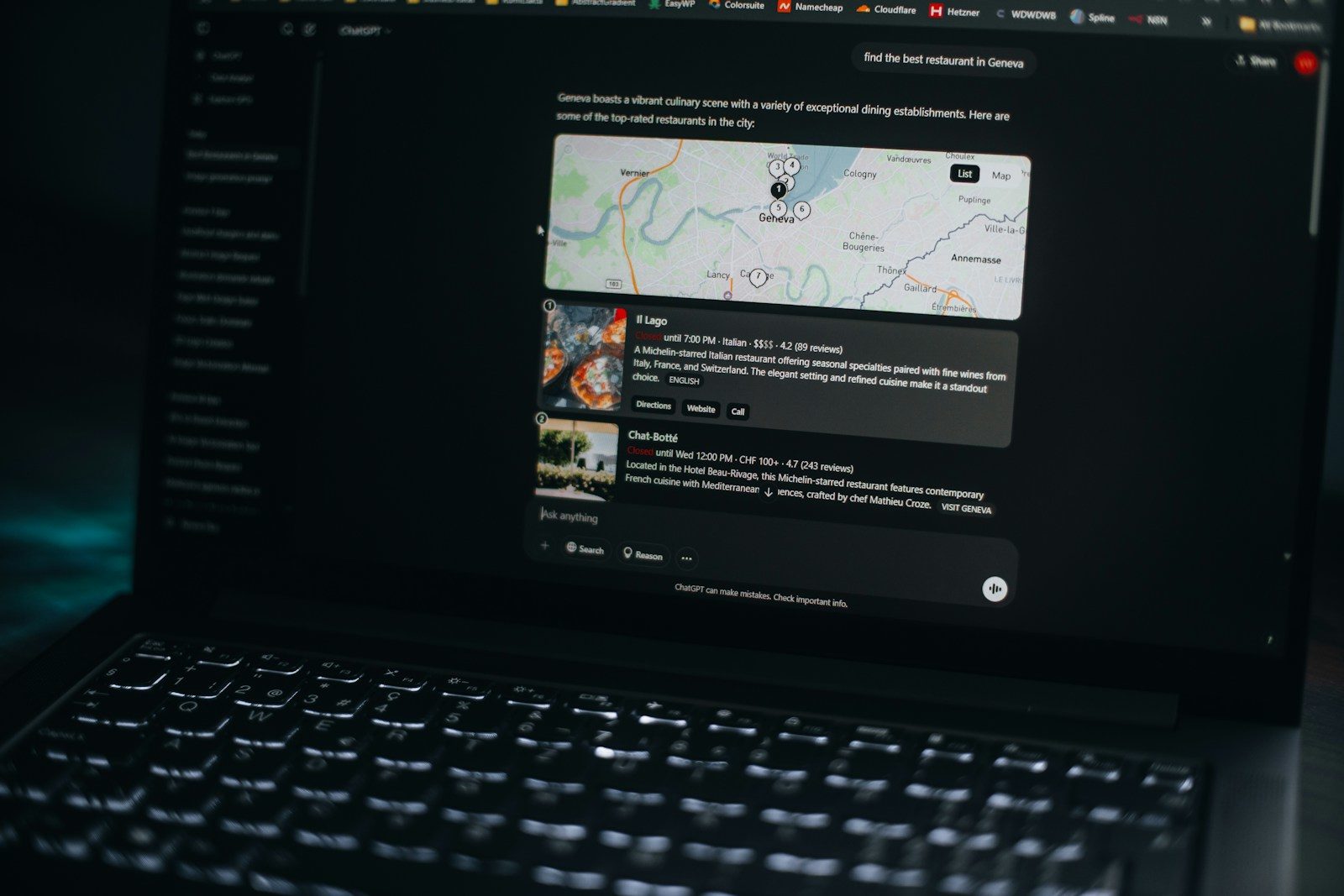

Un altro sviluppo critico è la disruption della ricerca. Per decenni, la barra di ricerca è stata il punto di ingresso a internet. Ora, i motori di risposta diretta stanno sostituendo il tradizionale elenco di link. Questo cambia l’economia del web. Se un utente ottiene una risposta completa da un’AI, non ha motivo di cliccare su un sito web di origine. Questo crea una crisi per editori e content creator che dipendono dal traffico per le entrate. Stiamo anche assistendo a un aumento dell’esecuzione locale dell’AI. Invece di inviare ogni query a un server remoto, i nuovi processori in laptop e smartphone consentono un’elaborazione privata, veloce e offline. Questo movimento verso l’edge è guidato sia dalla necessità di una minore latenza che da una crescente domanda di data privacy. Le organizzazioni si stanno rendendo conto che inviare dati aziendali sensibili a un cloud di terze parti è un rischio significativo che deve essere mitigato attraverso soluzioni hardware locali.

L’impatto globale dei sistemi automatizzati

L’influenza di queste tecnologie si estende ben oltre il settore tech. I governi stanno ora trattando le capacità dell’AI come una questione di sicurezza nazionale. Ciò ha portato a una corsa alla sovranità del silicio, in cui le nazioni investono miliardi per garantire di avere una produzione interna di chip. Stiamo assistendo a severi controlli sulle esportazioni e blocchi commerciali progettati per impedire ai rivali di accedere all’hardware più avanzato. Questa tensione geopolitica si riflette nello spazio normativo. L’Unione Europea e varie agenzie degli Stati Uniti stanno redigendo regole per governare il modo in cui i modelli vengono addestrati e distribuiti. Questi regolamenti si concentrano su trasparenza, bias e potenziale di uso improprio in settori critici come finanza e sanità. L’obiettivo è creare un framework che consenta la crescita prevenendo gli esiti più pericolosi del processo decisionale automatizzato.

La pressione energetica è la crisi silenziosa del settore. La domanda di elettricità da parte dei data center è destinata a crescere a un ritmo senza precedenti. Questo sta costringendo le aziende tech a diventare fornitori di energia, investendo in energia nucleare e massicci parchi solari per mantenere i server in funzione. In alcune regioni, la rete non riesce a tenere il passo con la domanda, portando a ritardi nella costruzione dei data center. Questo crea uno spostamento geografico in cui la tecnologia viene costruita, favorendo aree con energia economica e abbondante. Inoltre, l’uso di sistemi automatizzati in contesti militari sta accelerando. Dai droni autonomi agli strumenti di analisi strategica, l’integrazione dell’intelligenza artificiale nei sistemi di difesa sta cambiando la natura del conflitto. Ciò solleva urgenti questioni etiche sul ruolo della supervisione umana nelle decisioni letali e sul potenziale di rapida escalation negli scenari di guerra automatizzata.

Integrazione nel mondo reale e vita quotidiana

In una giornata tipica entro il , un professionista potrebbe iniziare la mattinata rivedendo un riepilogo delle comunicazioni notturne generato da un modello locale sul proprio telefono. Questo avviene senza che alcun dato lasci il dispositivo, garantendo che programmi privati e nomi dei clienti rimangano sicuri. Durante una riunione, un agente specializzato potrebbe ascoltare la conversazione e incrociare la discussione con i database aziendali interni in tempo reale. Questo agente non si limita a trascrivere. Identifica le contraddizioni nelle tempistiche dei progetti e suggerisce soluzioni basate su flussi di lavoro di successo precedenti. Questa è la realtà dello spostamento verso gli agenti, dove il software passa dall’essere un assistente passivo a un partecipante attivo nel processo di lavoro.

BotNews.today utilizza strumenti di intelligenza artificiale per ricercare, scrivere, modificare e tradurre contenuti. Il nostro team esamina e supervisiona il processo per mantenere le informazioni utili, chiare e affidabili.

L’impatto sui media e sull’informazione è altrettanto profondo. I deepfake sono andati oltre i semplici scambi di volto arrivando a video e audio ad alta fedeltà quasi impossibili da distinguere dalla realtà. Questo ha portato a una crisi di fiducia nei contenuti digitali. Per contrastare ciò, stiamo assistendo all’adozione di firme crittografiche per i media autentici. Ogni foto o video scattato su uno smartphone potrebbe presto portare un watermark digitale che ne provi l’origine. Questa battaglia per l’autenticità è una storia importante per chiunque sia coinvolto in giornalismo, politica o intrattenimento. I consumatori stanno diventando più scettici su ciò che vedono online, portando a una rinascita del valore dei brand di fiducia e delle fonti verificate. Il costo della verifica delle informazioni sta aumentando e coloro che possono fornire certezza in un’era di media sintetici deterranno un potere significativo.

Hai una storia, uno strumento, una tendenza o una domanda sull'IA che pensi dovremmo trattare? Inviaci la tua idea per un articolo — ci piacerebbe sentirla.Dobbiamo anche considerare l’impatto sul mercato del lavoro. Mentre alcuni posti di lavoro vengono sostituiti, altri vengono trasformati. Il movimento più significativo è nel livello del middle management, dove l’AI può gestire pianificazione, reportistica e monitoraggio delle prestazioni di base. Questo costringe a una rivalutazione di come appare la leadership umana. Il valore si sta spostando verso l’intelligenza emotiva, il problem solving complesso e il giudizio etico. Ai lavoratori viene chiesto di supervisionare flotte di agenti digitali, richiedendo una nuova serie di competenze tecniche e manageriali. Questo cambiamento sta avvenendo più velocemente di quanto i sistemi educativi possano adattarsi, creando un talent gap che le aziende stanno cercando di colmare con programmi di formazione interna. Il divario tra chi può utilizzare efficacemente questi strumenti e chi non può sta aumentando, portando a nuove forme di disuguaglianza economica che i governi stanno solo iniziando ad affrontare.

Scetticismo socratico e costi nascosti

Dobbiamo chiederci quale sia il vero costo di questa rapida adozione. Se facciamo affidamento su tre o quattro grandi aziende per la nostra infrastruttura cognitiva, cosa succede quando i loro interessi divergono dal bene pubblico? La centralizzazione dell’intelligenza è un rischio di cui pochi discutono in profondità. Stiamo scambiando il controllo locale per la comodità basata sul cloud, ma il prezzo di quella comodità è una perdita totale di privacy e una dipendenza da modelli di abbonamento che possono cambiare in qualsiasi momento. C’è anche la questione dei dati stessi. La maggior parte dei modelli è addestrata sull’output collettivo della cultura umana. È etico per una corporation catturare quel valore e rivendercelo senza compensazione per i creatori originali? Le attuali battaglie legali sul copyright sono solo l’inizio di una conversazione molto più ampia sulla proprietà delle informazioni.

C’è la tendenza a sovrastimare le capacità a breve termine di questi sistemi sottovalutando il loro impatto strutturale a lungo termine. Le persone si aspettano un’intelligenza generale in grado di risolvere qualsiasi problema, ma ciò che stiamo ottenendo è una serie di strumenti altamente efficienti e ristretti che sono integrati nel nostro software esistente. Il pericolo non è una macchina fuori controllo, ma un algoritmo poco compreso che prende decisioni su punteggi di credito, candidature di lavoro o trattamenti medici. Stiamo costruendo un mondo in cui la logica della macchina è spesso opaca per gli umani che la usano. Come possiamo ritenere responsabile un sistema se non possiamo spiegare perché ha raggiunto una conclusione specifica? Questi non sono solo problemi tecnici. Sono domande fondamentali su come vogliamo che la nostra società funzioni. Dobbiamo decidere se i guadagni di efficienza valgono la perdita di trasparenza e agenzia umana.

La sezione Power User

Per coloro che costruiscono e gestiscono questi sistemi, l’attenzione si è spostata sull’integrazione del flusso di lavoro e sull’ottimizzazione locale. L’era del semplice richiamo di una API massiccia viene sostituita da sofisticati livelli di orchestrazione. I power user stanno ora guardando ai seguenti vincoli tecnici:

- Limiti di velocità API e costo delle finestre di token per modelli a contesto lungo.

- L’uso della quantizzazione per eseguire modelli di grandi dimensioni su hardware di livello consumer senza una significativa perdita di precisione.

- L’implementazione della Retrieval Augmented Generation per garantire che i modelli abbiano accesso agli ultimi dati interni.

- La gestione di database vettoriali locali per un recupero rapido e privato delle informazioni.

L’automazione del flusso di lavoro non riguarda più semplici trigger. Implica il concatenamento di più modelli, dove un modello piccolo e veloce gestisce il routing iniziale e un modello più grande e capace gestisce il ragionamento complesso. Questo approccio a livelli è necessario per gestire costi e latenza. Stiamo anche assistendo a uno spostamento verso hardware specializzato come le NPU (Neural Processing Units) che diventano standard in tutti i nuovi dispositivi informatici. Ciò consente funzionalità AI persistenti e a basso consumo che vengono eseguite in background nel sistema operativo. Per gli sviluppatori, la sfida non è più solo scrivere codice, ma gestire il ciclo di vita dei dati utilizzati per il fine-tuning di questi sistemi. Il 20 percento degli utenti che comprende queste meccaniche sottostanti sarà quello che definirà la prossima generazione di architettura software.

- Le velocità di archiviazione NVMe stanno diventando un collo di bottiglia per il caricamento dei pesi dei grandi modelli in memoria.

- La larghezza di banda della memoria è più importante della potenza di calcolo grezza per molti compiti di inferenza.

- L’ascesa di small language models (SLM) che funzionano bene quanto i vecchi modelli di grandi dimensioni su compiti specifici.

Nota dell'editore: Abbiamo creato questo sito come un hub multilingue di notizie e guide sull'IA per le persone che non sono esperti di computer, ma che desiderano comunque comprendere l'intelligenza artificiale, usarla con maggiore fiducia e seguire il futuro che sta già arrivando.

In sintesi

I prossimi due anni saranno definiti da uno spostamento verso il pragmatismo. L’industria si sta allontanando dalla mentalità