10 AI-sztori, amely meghatározhatja 2026-ot

A generatív eszközök mézeshetei véget érnek. -ra a hangsúly a csevegőfelületek újdonságáról az azokat támogató háttérinfrastruktúrára helyeződik át. Olyan korszakba lépünk, ahol az elsődleges kérdés már nem az, mit mond a szoftver, hanem az, mi hajtja, ki birtokolja a súlyokat, és hol tárolják az adatokat. Az iparág egy strukturális váltás felé tart abban, hogyan dolgozzák fel és osztják el az információkat világszerte. Ez már nem a kísérleti botokról szól, hanem a gépi intelligencia integrációjáról az internet alapvető csőhálózatába és a fizikai elektromos hálózatba. A befektetők és a felhasználók a kezdeti izgalmakon túl már a növekvő működési költségeket és a jelenlegi hardverek korlátait látják. Az elkövetkező hónapokat azok a történetek uralják majd, amelyek ezekre az alapvető korlátokra adnak választ. A központosított cloud dominanciától egy töredezettebb és specializáltabb környezet felé mozdulunk el. A győztesek azok lesznek, akik kezelni tudják a hatalmas energiaigényeket és a betanítási adatok körüli egyre bonyolultabb jogi környezetet.

A gépi intelligencia strukturális váltása

Az első nagy sztori a modellhatalom koncentrációjáról szól. Jelenleg egy kis cégcsoport uralja a legfejlettebb frontier modelleket, ami szűk keresztmetszetet teremt az innovációban, mivel a kisebb szereplők kénytelenek ezekre a zárt rendszerekre építkezni. Ugyanakkor egyre nagyobb az igény az open weight modellek iránt, amelyek lehetővé teszik a szervezeteknek, hogy nagy teljesítményű rendszereket futtassanak saját hardverükön. A zárt és nyílt rendszerek közötti feszültség akkor éri el a töréspontot, amikor a cégek eldöntik, hogy magas előfizetési díjakat fizetnek, vagy saját infrastruktúrába fektetnek. Ezzel párhuzamosan a hardverpiac diverzifikálódik. Bár évek óta egy cég uralja a chippiacot, a versenytársak és a nagy cloud szolgáltatók belső fejlesztésű szilíciumprojektjei alternatívákat kínálnak. Ez az ellátási láncban bekövetkező változás elengedhetetlen az inference költségeinek csökkentéséhez és a nagy léptékű bevezetés fenntarthatóvá tételéhez az átlagos vállalkozások számára.

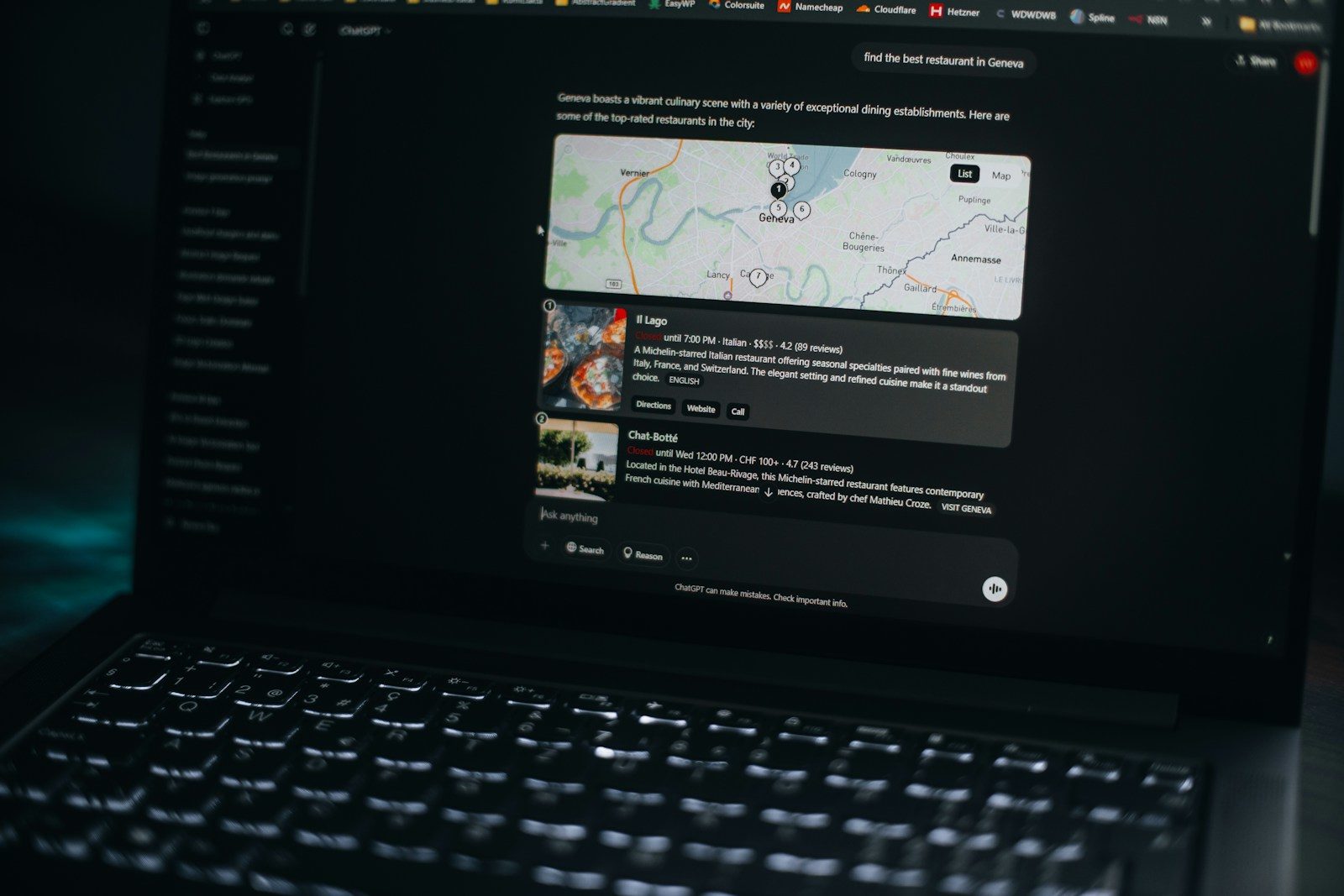

Egy másik kritikus fejlemény a keresés átalakulása. Évtizedekig a keresősáv volt az internet kapuja, most viszont a közvetlen válaszokat adó motorok váltják fel a hagyományos linklistákat. Ez megváltoztatja a web gazdaságtanát: ha a felhasználó teljes választ kap egy AI-tól, nincs oka átkattintani a forrásoldalra, ami válságot okoz a forgalomból élő kiadóknak és tartalomkészítőknek. Emellett növekszik a lokális AI-futtatás jelentősége is. Ahelyett, hogy minden lekérdezést távoli szerverre küldenének, a laptopok és telefonok új processzorai lehetővé teszik a privát, gyors és offline feldolgozást. Ez az edge felé mutató mozgás az alacsonyabb latency igénye és az adatvédelem iránti növekvő kereslet miatt alakult ki. A szervezetek rájönnek, hogy érzékeny vállalati adatok harmadik fél cloudjába küldése jelentős kockázat, amelyet lokális hardvermegoldásokkal kell mérsékelni.

Az automatizált rendszerek globális hatása

Ezen technológiák hatása messze túlmutat a tech szektoron. A kormányok az AI-képességeket már nemzetbiztonsági kérdésként kezelik, ami a szilícium-szuverenitásért folytatott versenyhez vezetett, ahol nemzetek milliárdokat fektetnek be a hazai chipgyártás biztosítására. Szigorú exportellenőrzéseket és kereskedelmi blokádokat látunk, amelyek célja megakadályozni, hogy a riválisok hozzáférjenek a legfejlettebb hardverekhez. Ez a geopolitikai feszültség a szabályozási térben is tükröződik. Az Európai Unió és különböző amerikai ügynökségek szabályokat dolgoznak ki a modellek betanítására és bevetésére vonatkozóan. Ezek a szabályozások az átláthatóságra, a torzításra és a kritikus ágazatokban – mint a pénzügy vagy az egészségügy – történő esetleges visszaélésekre fókuszálnak. A cél egy olyan keretrendszer létrehozása, amely lehetővé teszi a növekedést, miközben megelőzi az automatizált döntéshozatal legveszélyesebb kimeneteleit.

Az energiaigény az iparág csendes válsága. Az adatközpontok villamosenergia-igénye példátlan ütemben növekszik, ami arra kényszeríti a tech cégeket, hogy energiaellátókká váljanak: atomenergiába és hatalmas naperőművekbe fektetnek, hogy szervereik működjenek. Egyes régiókban a hálózat nem bírja a terhelést, ami késlelteti az adatközpontok építését. Ez földrajzi eltolódást okoz a tech iparban, az olcsó és bőséges energiával rendelkező területek felé. Továbbá az automatizált rendszerek katonai alkalmazása is felgyorsult. Az autonóm drónoktól a stratégiai elemző eszközökig a gépi intelligencia integrációja a védelmi rendszerekbe megváltoztatja a konfliktusok természetét. Ez sürgető etikai kérdéseket vet fel az emberi felügyelet szerepéről a halálos döntésekben és az automatizált hadviselés gyors eszkalációjának lehetőségéről.

Valós integráció és mindennapi élet

Egy átlagos napon -ra egy szakember a reggelét azzal kezdheti, hogy áttekinti az éjszakai kommunikációk összefoglalóját, amelyet a telefonján lévő lokális modell generált. Ez úgy történik, hogy semmilyen adat nem hagyja el az eszközt, így a privát naptárak és az ügyfélnevek biztonságban maradnak. Egy megbeszélés során egy speciális agent figyelheti a beszélgetést, és valós időben összevetheti azt a belső vállalati adatbázisokkal. Ez az agent nemcsak átír, hanem azonosítja a projektütemezések ellentmondásait, és javaslatokat tesz a korábbi sikeres munkafolyamatok alapján. Ez az agentic shift valósága, ahol a szoftver passzív asszisztensből a munkafolyamat aktív résztvevőjévé válik.

A BotNews.today mesterséges intelligencia eszközöket használ a tartalom kutatására, írására, szerkesztésére és fordítására. Csapatunk felülvizsgálja és felügyeli a folyamatot, hogy az információ hasznos, világos és megbízható maradjon.

A média és az információk terén gyakorolt hatás ugyanilyen mélyreható. A deepfake-ek túlléptek az egyszerű arc-cseréken, és olyan nagy hűségű videókat és hanganyagokat hoznak létre, amelyeket szinte lehetetlen megkülönböztetni a valóságtól. Ez bizalmi válsághoz vezetett a digitális tartalmak terén. Ennek ellensúlyozására kriptográfiai aláírásokat vezetnek be a hiteles média számára. Hamarosan minden okostelefonnal készített fotó vagy videó digitális vízjelet hordozhat, amely bizonyítja az eredetét. Ez a hitelességért folytatott harc kulcsfontosságú téma mindenki számára, aki újságírással, politikával vagy szórakoztatással foglalkozik. A fogyasztók egyre szkeptikusabbak az online látottakkal szemben, ami a megbízható márkák és ellenőrzött források értékének újjáéledéséhez vezet. Az információellenőrzés költségei nőnek, és azok, akik bizonyosságot tudnak nyújtani a szintetikus média korában, jelentős hatalommal bírnak majd.

Van egy AI-történet, eszköz, trend vagy kérdés, amiről úgy gondolja, hogy foglalkoznunk kellene vele? Küldje el nekünk cikkötletét — szívesen meghallgatnánk.Figyelembe kell vennünk a munkaerőpiacra gyakorolt hatást is. Bár egyes munkahelyek megszűnnek, mások átalakulnak. A legjelentősebb mozgás a középvezetői rétegben tapasztalható, ahol az AI átveheti az ütemezést, a jelentéskészítést és az alapvető teljesítménykövetést. Ez az emberi vezetés újragondolására kényszerít. Az érték az érzelmi intelligencia, a komplex problémamegoldás és az etikai ítélőképesség felé tolódik. A munkavállalóktól elvárják, hogy digitális agent-flottákat felügyeljenek, ami új technikai és vezetői készségeket igényel. Ez a változás gyorsabban zajlik, mint ahogy az oktatási rendszerek alkalmazkodni tudnának, ami olyan tehetséghiányt teremt, amelyet a cégek belső képzési programokkal próbálnak pótolni. A szakadék azok között, akik hatékonyan tudják használni ezeket az eszközöket, és azok között, akik nem, szélesedik, ami az gazdasági egyenlőtlenség új formáihoz vezet, amelyeket a kormányok csak most kezdenek kezelni.

Szókratészi szkepticizmus és a rejtett költségek

Fel kell tennünk a kérdést, mi a valódi ára ennek a gyors adaptációnak. Ha három-négy nagy cégre bízzuk a kognitív infrastruktúránkat, mi történik, ha az érdekeik eltérnek a közjótól? Az intelligencia központosítása olyan kockázat, amelyről kevesen beszélnek mélyrehatóan. A lokális kontrollt cseréljük le a cloud alapú kényelemre, de ennek a kényelemnek az ára a teljes adatvédelmi veszteség és az előfizetési modellektől való függőség, amelyek bármikor változhatnak. Ott van az adatok kérdése is. A legtöbb modellt az emberi kultúra kollektív termékein tanítják. Etikus-e, ha egy vállalat kisajátítja ezt az értéket, és eladja nekünk anélkül, hogy kártalanítaná az eredeti alkotókat? A szerzői jogi csaták csak a kezdetei egy sokkal nagyobb beszélgetésnek az információ tulajdonjogáról.

Hajlamosak vagyunk túlbecsülni ezen rendszerek rövid távú képességeit, miközben alábecsüljük hosszú távú strukturális hatásukat. Az emberek olyan általános intelligenciát várnak, amely bármilyen problémát megold, de amit kapunk, az egy sor rendkívül hatékony, szűk körű eszköz, amelyek integrálva vannak meglévő szoftvereinkbe. A veszély nem egy elszabadult gép, hanem egy rosszul értelmezett algoritmus, amely hitelminősítésekről, álláspályázatokról vagy orvosi kezelésekről dönt. Olyan világot építünk, ahol a gép logikája gyakran átláthatatlan az azt használó emberek számára. Hogyan vonhatunk felelősségre egy rendszert, ha nem tudjuk megmagyarázni, miért jutott egy adott következtetésre? Ezek nemcsak technikai problémák, hanem alapvető kérdések arról, hogyan akarjuk, hogy társadalmunk működjön. El kell döntenünk, hogy a hatékonyságnövekedés megéri-e az átláthatóság és az emberi cselekvőképesség elvesztését.

A Power User szekció

Azok számára, akik ezeket a rendszereket építik és kezelik, a hangsúly a munkafolyamat-integrációra és a lokális optimalizálásra helyeződött át. A hatalmas API-k hívásának korszaka helyett a kifinomult orchestrációs rétegek kerülnek előtérbe. A power userek most a következő technikai korlátokat figyelik:

- API rate limitek és a token ablakok költsége hosszú kontextusú modelleknél.

- Kvantálás használata nagy modellek fogyasztói kategóriájú hardveren történő futtatásához, jelentős pontosságvesztés nélkül.

- Retrieval Augmented Generation bevezetése annak biztosítására, hogy a modellek hozzáférjenek a legfrissebb belső adatokhoz.

- Lokális vektoradatbázisok kezelése a gyors és privát információkereséshez.

A munkafolyamat-automatizálás már nem egyszerű triggerekről szól. Több modell összekapcsolását foglalja magában, ahol egy kicsi, gyors modell kezeli az elsődleges útválasztást, egy nagyobb, képesebb modell pedig a komplex érvelést. Ez a rétegzett megközelítés szükséges a költségek és a latency kezeléséhez. Azt is látjuk, hogy a specializált hardverek, mint az NPU-k (Neural Processing Units), standarddá válnak minden új számítástechnikai eszközben. Ez lehetővé teszi a folyamatos, alacsony fogyasztású AI-funkciókat, amelyek az operációs rendszer hátterében futnak. A fejlesztők számára a kihívás már nemcsak a kódírás, hanem a rendszerek finomhangolásához használt adatok életciklusának kezelése. Az a 20 százaléknyi felhasználó, aki érti ezeket a mögöttes mechanizmusokat, fogja meghatározni a szoftverarchitektúra következő generációját.

- Az NVMe tárolási sebességek szűk keresztmetszetté válnak a nagy modell súlyok memóriába töltésénél.

- A memória sávszélesség sok inference feladatnál fontosabb, mint a nyers számítási teljesítmény.

- A kis nyelvi modellek (SLM-ek) térnyerése, amelyek specifikus feladatokon ugyanolyan jól teljesítenek, mint a régebbi nagy modellek.

A szerkesztő megjegyzése: Ezt az oldalt többnyelvű AI hírek és útmutatók központjaként hoztuk létre olyan emberek számára, akik nem számítógépes zsenik, de mégis szeretnék megérteni a mesterséges intelligenciát, magabiztosabban használni, és követni a már megérkező jövőt.

A lényeg

A következő két évet a pragmatizmus felé való elmozdulás határozza meg. Az iparág távolodik a