Les 10 tendances IA qui pourraient définir 2026

La lune de miel avec les outils génératifs touche à sa fin. D’ici , l’attention se déplacera de la nouveauté des interfaces de chat vers l’infrastructure sous-jacente qui les soutient. Nous entrons dans une ère où la préoccupation principale n’est plus ce que le logiciel peut dire, mais comment il est alimenté, qui détient les poids des modèles et où résident les données. L’industrie s’oriente vers un changement structurel dans la manière dont l’information est traitée et distribuée à travers le monde. Il ne s’agit plus de simples bots expérimentaux. Il est question de l’intégration de l’intelligence artificielle dans la tuyauterie fondamentale d’Internet et dans le réseau électrique physique. Les investisseurs et les utilisateurs commencent à voir au-delà de l’excitation initiale pour constater les coûts opérationnels croissants et les limites du hardware actuel. Les sujets qui domineront les prochains mois sont ceux qui traitent de ces contraintes fondamentales. Nous assistons à un éloignement de la domination centralisée du cloud vers un environnement plus fragmenté et spécialisé. Les gagnants seront ceux qui sauront gérer les besoins énergétiques massifs et l’environnement juridique de plus en plus complexe entourant les données d’entraînement.

Le changement structurel de l’intelligence artificielle

Le premier sujet majeur concerne la concentration de la puissance des modèles. Un petit groupe d’entreprises contrôle actuellement les modèles de pointe les plus avancés. Cela crée un goulot d’étranglement pour l’innovation, car les plus petits acteurs doivent s’appuyer sur ces systèmes propriétaires. Cependant, nous voyons une poussée pour des modèles à poids ouverts (open weight) qui permettent aux organisations d’exécuter des systèmes haute performance sur leur propre matériel. Cette tension entre systèmes fermés et ouverts atteindra un point de rupture lorsque les entreprises devront décider si elles préfèrent payer des abonnements coûteux ou investir dans leur propre infrastructure. Parallèlement, le marché du hardware se diversifie. Alors qu’une entreprise a dominé le marché des puces pendant des années, des concurrents et des projets de silicium internes de grands fournisseurs cloud commencent à offrir des alternatives. Ce changement dans la supply chain est essentiel pour réduire le coût de l’inférence et rendre le déploiement à grande échelle durable pour l’entreprise moyenne.

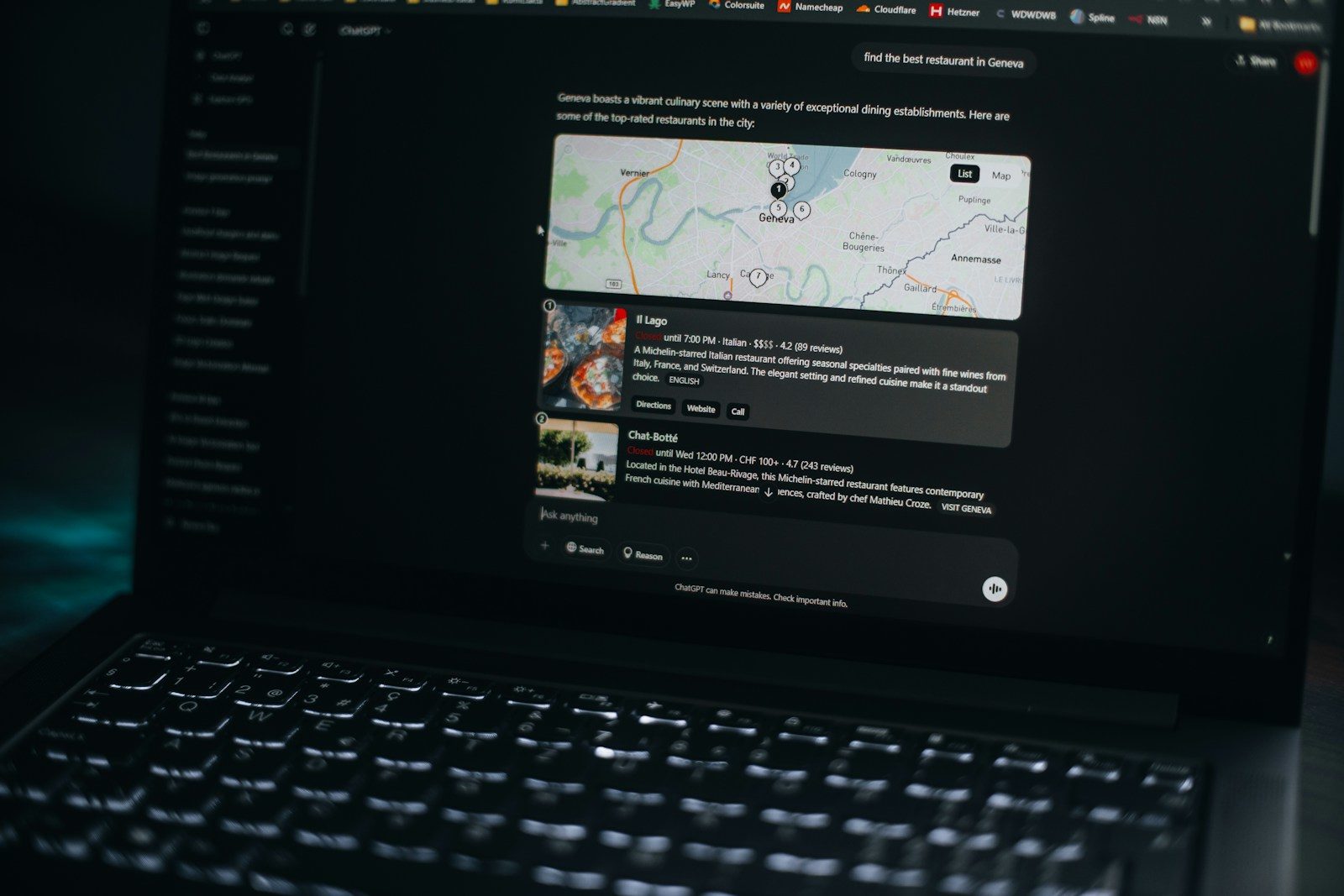

Un autre développement critique est la perturbation de la recherche. Pendant des décennies, la barre de recherche a été le point d’entrée vers Internet. Désormais, les moteurs de réponse directe remplacent la liste traditionnelle de liens. Cela modifie l’économie du web. Si un utilisateur obtient une réponse complète d’une IA, il n’a aucune raison de cliquer vers un site source. Cela crée une crise pour les éditeurs et les créateurs de contenu qui dépendent du trafic pour leurs revenus. Nous assistons également à une montée en puissance de l’exécution locale de l’IA. Au lieu d’envoyer chaque requête à un serveur distant, de nouveaux processeurs dans les ordinateurs portables et les téléphones permettent un traitement privé, rapide et hors ligne. Ce mouvement vers l’edge est motivé à la fois par un besoin de latence plus faible et une demande croissante pour la confidentialité des données. Les organisations réalisent qu’envoyer des données d’entreprise sensibles à un cloud tiers est un risque important qui doit être atténué par des solutions matérielles locales.

L’impact mondial des systèmes automatisés

L’influence de ces technologies s’étend bien au-delà du secteur tech. Les gouvernements traitent désormais les capacités de l’IA comme une question de sécurité nationale. Cela a conduit à une course à la souveraineté du silicium, où les nations investissent des milliards pour garantir une production nationale de puces. Nous observons des contrôles à l’exportation stricts et des blocs commerciaux conçus pour empêcher les rivaux d’accéder au matériel le plus avancé. Cette tension géopolitique se reflète dans l’espace réglementaire. L’Union européenne et diverses agences des États-Unis rédigent des règles pour régir la manière dont les modèles sont entraînés et déployés. Ces réglementations se concentrent sur la transparence, les biais et le potentiel de mauvaise utilisation dans des secteurs critiques comme la finance et la santé. L’objectif est de créer un cadre permettant la croissance tout en prévenant les résultats les plus dangereux de la prise de décision automatisée.

La pression énergétique est la crise silencieuse de l’industrie. La demande d’électricité des data centers devrait croître à un rythme sans précédent. Cela force les entreprises technologiques à devenir des fournisseurs d’énergie, investissant dans l’énergie nucléaire et des fermes solaires massives pour maintenir leurs serveurs en marche. Dans certaines régions, le réseau ne peut pas suivre la demande, entraînant des retards dans la construction des data centers. Cela crée un déplacement géographique des lieux où la technologie est construite, favorisant les zones disposant d’une énergie bon marché et abondante. De plus, l’utilisation de systèmes automatisés dans des contextes militaires s’accélère. Des drones autonomes aux outils d’analyse stratégique, l’intégration de l’intelligence artificielle dans les systèmes de défense change la nature des conflits. Cela soulève des questions éthiques urgentes sur le rôle de la supervision humaine dans les décisions létales et le potentiel d’escalade rapide dans les scénarios de guerre automatisée.

Intégration dans le monde réel et vie quotidienne

Dans une journée type d’ici , un professionnel pourrait commencer sa matinée en examinant un résumé des communications nocturnes généré par un modèle local sur son téléphone. Cela se produit sans qu’aucune donnée ne quitte l’appareil, garantissant que les agendas privés et les noms des clients restent sécurisés. Pendant une réunion, un agent spécialisé pourrait écouter la conversation et croiser la discussion avec les bases de données internes de l’entreprise en temps réel. Cet agent ne se contente pas de transcrire. Il identifie les contradictions dans les calendriers de projet et suggère des solutions basées sur des flux de travail réussis précédents. C’est la réalité du changement agentique, où le logiciel passe d’un assistant passif à un participant actif dans le processus de travail.

BotNews.today utilise des outils d'IA pour rechercher, rédiger, éditer et traduire du contenu. Notre équipe examine et supervise le processus pour que les informations restent utiles, claires et fiables.

L’impact sur les médias et l’information est tout aussi profond. Les deepfakes ont dépassé les simples échanges de visages pour atteindre une vidéo et un audio haute fidélité presque impossibles à distinguer de la réalité. Cela a conduit à une crise de confiance dans le contenu numérique. Pour contrer cela, nous voyons l’adoption de signatures cryptographiques pour les médias authentiques. Chaque photo ou vidéo prise sur un smartphone pourrait bientôt porter un filigrane numérique prouvant son origine. Cette bataille pour l’authenticité est un sujet majeur pour quiconque travaille dans le journalisme, la politique ou le divertissement. Les consommateurs deviennent plus sceptiques vis-à-vis de ce qu’ils voient en ligne, ce qui entraîne un regain de valeur pour les marques de confiance et les sources vérifiées. Le coût de la vérification de l’information augmente, et ceux qui peuvent fournir une certitude à l’ère des médias synthétiques détiendront un pouvoir significatif.

Vous avez une histoire, un outil, une tendance ou une question sur l'IA que nous devrions couvrir ? Envoyez-nous votre idée d'article — nous serions ravis de l'entendre.Nous devons également considérer l’impact sur le marché du travail. Alors que certains emplois sont déplacés, d’autres sont transformés. Le mouvement le plus significatif se situe au niveau du management intermédiaire, où l’IA peut gérer la planification, le reporting et le suivi de performance de base. Cela force une réévaluation de ce à quoi ressemble le leadership humain. La valeur se déplace vers l’intelligence émotionnelle, la résolution de problèmes complexes et le jugement éthique. On demande aux travailleurs de superviser des flottes d’agents numériques, ce qui nécessite un nouvel ensemble de compétences techniques et managériales. Ce changement se produit plus rapidement que les systèmes éducatifs ne peuvent s’adapter, créant un écart de talents que les entreprises tentent de combler avec des programmes de formation internes. Le fossé entre ceux qui peuvent utiliser efficacement ces outils et ceux qui ne le peuvent pas se creuse, menant à de nouvelles formes d’inégalités économiques que les gouvernements commencent à peine à aborder.

Scepticisme socratique et coûts cachés

Nous devons nous demander quel est le coût réel de cette adoption rapide. Si nous dépendons de trois ou quatre grandes entreprises pour notre infrastructure cognitive, que se passe-t-il lorsque leurs intérêts divergent du bien public ? La centralisation de l’intelligence est un risque dont peu discutent en profondeur. Nous échangeons le contrôle local contre la commodité du cloud, mais le prix de cette commodité est une perte totale de confidentialité et une dépendance à des modèles d’abonnement qui peuvent changer à tout moment. Il y a aussi la question des données elles-mêmes. La plupart des modèles sont entraînés sur la production collective de la culture humaine. Est-il éthique pour une corporation de capturer cette valeur et de nous la revendre sans compensation pour les créateurs originaux ? Les batailles juridiques actuelles sur le droit d’auteur ne sont que le début d’une conversation beaucoup plus large sur la propriété de l’information.

Il existe une tendance à surestimer les capacités à court terme de ces systèmes tout en sous-estimant leur impact structurel à long terme. Les gens attendent une intelligence générale capable de résoudre n’importe quel problème, mais ce que nous obtenons, ce sont des séries d’outils hautement efficaces et spécialisés qui sont intégrés dans nos logiciels existants. Le danger n’est pas une machine rebelle, mais un algorithme mal compris prenant des décisions sur les scores de crédit, les candidatures à un emploi ou les traitements médicaux. Nous construisons un monde où la logique de la machine est souvent opaque pour les humains qui l’utilisent. Comment tenir un système responsable si nous ne pouvons pas expliquer pourquoi il est parvenu à une conclusion spécifique ? Ce ne sont pas seulement des problèmes techniques. Ce sont des questions fondamentales sur la façon dont nous voulons que notre société fonctionne. Nous devons décider si les gains d’efficacité valent la perte de transparence et d’agence humaine.

La section des Power Users

Pour ceux qui construisent et gèrent ces systèmes, l’accent s’est déplacé vers l’intégration des flux de travail et l’optimisation locale. L’ère du simple appel à une API massive est remplacée par des couches d’orchestration sophistiquées. Les power users examinent désormais les contraintes techniques suivantes :

- Les limites de débit API et le coût des fenêtres de jetons pour les modèles à long contexte.

- L’utilisation de la quantification pour exécuter de grands modèles sur du matériel grand public sans perte significative de précision.

- La mise en œuvre de la génération augmentée par récupération (RAG) pour garantir que les modèles ont accès aux dernières données internes.

- La gestion des bases de données vectorielles locales pour une récupération d’informations rapide et privée.

L’automatisation des flux de travail ne concerne plus de simples déclencheurs. Elle implique d’enchaîner plusieurs modèles ensemble, où un petit modèle rapide gère le routage initial et un modèle plus grand et plus capable gère le raisonnement complexe. Cette approche par niveaux est nécessaire pour gérer les coûts et la latence. Nous voyons également un mouvement vers du matériel spécialisé comme les NPU (Neural Processing Units) devenant standard dans tous les nouveaux appareils informatiques. Cela permet des fonctionnalités IA persistantes et à faible consommation qui s’exécutent en arrière-plan du système d’exploitation. Pour les développeurs, le défi n’est plus seulement d’écrire du code, mais de gérer le cycle de vie des données utilisées pour affiner ces systèmes. Les 20 % d’utilisateurs qui comprennent ces mécanismes sous-jacents seront ceux qui définiront la prochaine génération d’architecture logicielle.

- Les vitesses de stockage NVMe deviennent un goulot d’étranglement pour le chargement des poids des grands modèles en mémoire.

- La bande passante mémoire est plus importante que la puissance de calcul brute pour de nombreuses tâches d’inférence.

- La montée des petits modèles de langage (SLM) qui fonctionnent aussi bien que les anciens grands modèles sur des tâches spécifiques.

Note de l’éditeur : Nous avons créé ce site comme un centre multilingue d’actualités et de guides sur l’IA pour les personnes qui ne sont pas des experts en informatique, mais qui souhaitent tout de même comprendre l’intelligence artificielle, l’utiliser avec plus de confiance et suivre l’avenir qui est déjà en marche.

En résumé

Les deux prochaines années seront définies par un mouvement vers le pragmatisme. L’industrie s’éloigne de la mentalité « bouger vite et casser des choses » vers une approche plus disciplinée pour construire des systèmes fiables, évolutifs et éthiques. Nous assistons à l’émergence d’une nouvelle stack où le matériel local, les modèles spécialisés et une conformité réglementaire stricte sont la norme. Les sujets qui comptent ne concernent pas la dernière démo de chatbot, mais le travail acharné d’intégration de ces outils dans les structures physiques et juridiques de notre monde. Le succès ne sera pas mesuré par la complexité du modèle, mais par l’utilité et la sécurité qu’il apporte à l’utilisateur final. La transition de l’engouement vers l’utilité est bien entamée, et les résultats seront plus subtils et plus omniprésents que beaucoup ne le pensent.

Vous avez trouvé une erreur ou quelque chose qui doit être corrigé ? Faites-le nous savoir.